Il processo di debunk è estremamente importante in questa epoca famosa per la post-truth. Tutti possono scrivere in rete e tanti si inventano notizie per acchiappare click e guadagnare con la pubblicità. Molti sono, però, in cerca di notorietà per soddisfare il proprio egocentrismo. Tra questi anche molti studiosi che utilizzano questa notorietà per reperire fondi per portare avanti ricerche piuttosto improbabili. Ed ecco che così nascono e si diffondono movimenti a favore dell’omeopatia (che altro non è che un approccio magico alla risoluzione di problem di salute) e movimenti antivaccinisti (che, utilizzando paure ataviche ed ingiustificate, non fanno altro che aprire la strada a patologie che solo apparentemente sembrano innocue o debellate).

Ben vengano allora blogger, youtuber ed altri personaggi che dal mondo scientifico si immettono nella divulgazione per contrastare in modo corretto, con informazioni di prima mano, l’onda antiscientifica. Leggo sempre con piacere la competenza con cui i debunker (nome corretto di chi lotta contro I movimenti antiscientifici) affrontano i “fuffari” in rete.

Nei giorni passati ho letto con enorme interesse un articolo scritto dal Dr. Salvo Di Grazia conosciuto in rete come MedBunker. È a questo link.

Nel suo lavoro, MedBunker affronta con competenza e cognizione di causa i problemi legati all’intervista rilasciata dalla Dr.ssa Gatti nel servizio della trasmissione Report in merito ai vaccini.

MedBunker ci fa capire come le affermazioni fatte dalla Dott.ssa Gatti in merito alle nanoparticelle nei vaccini siano infondate. Lo fa in modo molto semplice.

Tanto per capire di cosa si parla, le nanoparticelle sono sistemi solidi dispersi in un mezzo qualsiasi e si distinguono, solo ed esclusivamente, per le loro dimensioni. Il suffisso “nano”, infatti, significa 10-9, ovvero 1/1000000000. Anteporre il suffisso “nano” alla parola “particella” significa solo dire che si stanno prendendo in considerazione sistemi solidi le cui dimensioni ricadono nell’ordine del miliardesimo di metro. In altre parole, le nanoparticelle possono essere di ogni tipo. Esistono nanoparticelle di origine organica, come nanoparticelle di origine inorganica.

Quando insegno la chimica del suolo, evidenzio che sistemi chimici che hanno le dimensioni anzidette e che sono disperse nella fase acquosa dei suoli, costituiscono quelli che vengono indicati come “colloidi del suolo”. I minerali argillosi e la sostanza organica naturale sono i due tipici esempi di “nanoparticelle” (i primi di origine inorganica, la seconda di origine organica) presenti in natura.

MedBunker ha ragione. Le nanoparticelle sono ovunque. Sono tossiche? Dobbiamo averne paura? Certamente no. La tossicità di un sistema chimico (qualunque sia la sua dimensione) dipende da tanti fattori tra cui, non ultimo e molto importante, la concentrazione. È la dose che fa il veleno come ci ha insegnato Paracelso. Tuttavia non voglio scrivere un trattato di tossicologia chimica.

In questa sede voglio centrare la mia attenzione su quello che io reputo un errore sempre più frequente nei processi di debunk e che potrebbe, a mio avviso, spuntare le armi che abbiamo a disposizione per contrastare il proliferare di sciocchezze on-line. Prendo ad esempio MedBunker solo perché è l’ultimo degli articoli in cui ho notato questo errore. Non me ne voglia Salvo Di Grazia se uso il suo lavoro per scrivere questa nota. La stessa tipologia di errore l’ho trovata ovunque, anche nelle discussioni interminabili nei vari siti di debunk che gestisco in rete.

MedBunker, dopo aver smontato le argomentazioni della Dottoressa Gatti in merito alle nanoparticelle nei vaccini, scrive:

“Il suo microscopio ha trovato migliaia di nanoparticelle in flaconi di vaccino. Prima lo ha fatto sapere tramite internet e poi con un libro, edito da Macrolibrarsi, casa editrice specializzata in libri sui misteri, sugli UFO e sui poteri paranormali. Ma in effetti non era sufficiente e tutti le chiedevano a gran voce di pubblicare (come dovrebbe fare qualsiasi scienziato) in una rivista scientifica, non ci pensa due volte ed in effetti lo fa. Peccato che la rivista scientifica che ha scelto è praticamente sconosciuta, non ha nemmeno un “impact factor” (fattore d’impatto, misura l’importanza di una rivista scientifica) ed il suo editore, Medcrave, è noto per essere un “predatory journal“, cioè un editore che accetta qualsiasi cosa, dallo studio vero a quello falso o stupido, dietro pagamento, protagonista persino di un editoriale del BMJ sulle mail indesiderate, lo spam, che arriva ai ricercatori con la richiesta di pubblicare qualcosa“.

Era proprio necessario invocare i “predatory journals”? Era proprio necessario evidenziare che il giornale scelto dalla Dottoressa Gatti è privo di impact factor?

Come probabilmente è noto, sono nel mondo scientifico da quasi una trentina di anni. In tutti questi anni ho operato come peer reviewer (ovvero revisore scientifico) per tantissime riviste. Da Nature a Ciencia Rural, la prima con impact factor altissimo, la seconda con impact factor molto basso, ma egualmente dignitosa e piena di lavori estremamente interessanti. Ho operato come revisore scientifico per riviste appena nate prive, per questo motivo, di impact factor e per riviste che nel tempo non hanno mai avuto un impact factor. Ebbene sì, per essere indicizzati ed avere un IF bisogna affidarsi alla Thomson Reuters, agenzia privata, oggi proprietà della Clarivate Analytics, che chiede un “obolo” che non tutti sono in grado di/o vogliono pagare. In alternativa indicizzazioni gratis si possono ottenere mediante altre agenzie come Google Scholar, Scopus, ResearchGate ed oltre. Spuntano agenzie di rating bibliografico ogni momento. Non è detto che una rivista indicizzata con Google Scholar, Scopus o altro, sia indicizzata anche dalla Thomson Reuters. Ed in ogni caso, quale indice è quello più qualificato? Chi decide quale parametro bibliometrico è migliore? In ambito accademico e per il mio settore disciplinare, per esempio, si è deciso arbitrariamente che Thomson Reuters e Scopus debbano essere le uniche agenzie da considerare per il superamento dell’abilitazione scientifica nazionale. Altri settori possono decidere altrimenti. Molti colleghi decidono arbitrariamente che il loro indice di Hirsch (o h-index, un parametro quantitativo che misura l’impatto che il singolo scienziato ha sulla sua comunità di riferimento) debba essere quello di Google Scholar perché questo motore è in grado di indicizzare molto di più rispetto ai motori precedentemente citati. Io stesso per esempio ho un h-index che varia in funzione del motore di ricerca presso cui i miei lavori sono indicizzati. Un motore di ricerca che indicizza un numero di lavori inferiore ad un altro, produrrà un h-index inferiore perché, gioco forza, non può prendere in considerazione le citazioni dei lavori che non è in grado di indicizzare. Non si possono mettere nel computo “oggetti” che, di fatto, per quel motore non esistono.

Lo stesso dicasi per quanto riguarda l’impact factor delle riviste di cui ha parlato MedBunker nel sua articolo. Ci sono riviste indicizzate un po’ ovunque e non sempre l’IF elaborato dai diversi database coincide.

È vero. Ci sono riviste “predatorie” che pubblicherebbero di tutto pur di battere cassa. Ma è altrettanto vero che il giudizio che un peer reviewer elabora su uno specifico articolo è indipendente da tutti i parametri quantitativi precedentemente citati. Ogni reviewer (revisore) valuta il merito del lavoro che è chiamato a giudicare. Non si possono certo replicare in laboratorio gli esperimenti di cui si legge in un lavoro (è impossibile e un revisore avrebbe bisogno di fondi e personale in gran quantità pe replicare gli esperimenti di altri). Si valuta la congruenza tra il disegno sperimentale, i dati ottenuti e le conclusioni elaborate. Se c’è congruenza, il lavoro passa e viene pubblicato. Se non c’è congruenza, il lavoro viene rifiutato o accettato con major/minor revisions, ovvero si chiede all’autore (autori) di rivedere il lavoro e la procedura sperimentale perché sono state notate delle fallacie.

In modo oggettivo MedBunker evidenzia che il lavoro della Dr.ssa Gatti è stato preso in considerazione nel merito da qualcun altro. Ed è ciò che, secondo me, deve essere l’unica cosa da prendere in considerazione: tutto il resto non conta. Che la casa editrice sia “predatoria”, che la rivista non sia “impattata” non sono argomentazioni da prendere in considerazione. Ciò che va evidenziato è l’incongruenza del disegno sperimentale rispetto ai dati prodotti ed alle conclusioni raggiunte. Nient’altro. Il lavoro è stato pubblicato. È stato oggetto di revisione? Sì. Allora bene. La revisione non è stata assegnata a “giudici” esperti. Questo deve essere segnalato alla rivista che prenderà, poi, le opportune decisioni. È così che, a mio avviso, si cresce. Non puntando il dito contro il contenitore per evidenziare le mancanze del contenuto.

In merito alle riviste predatorie ed al perché su di esse molti autori Italiani inviino i loro prodotti, nonché i limiti dei database che indicizzano le riviste predatorie, si trova qualcosa a questo link o a quest’altro.

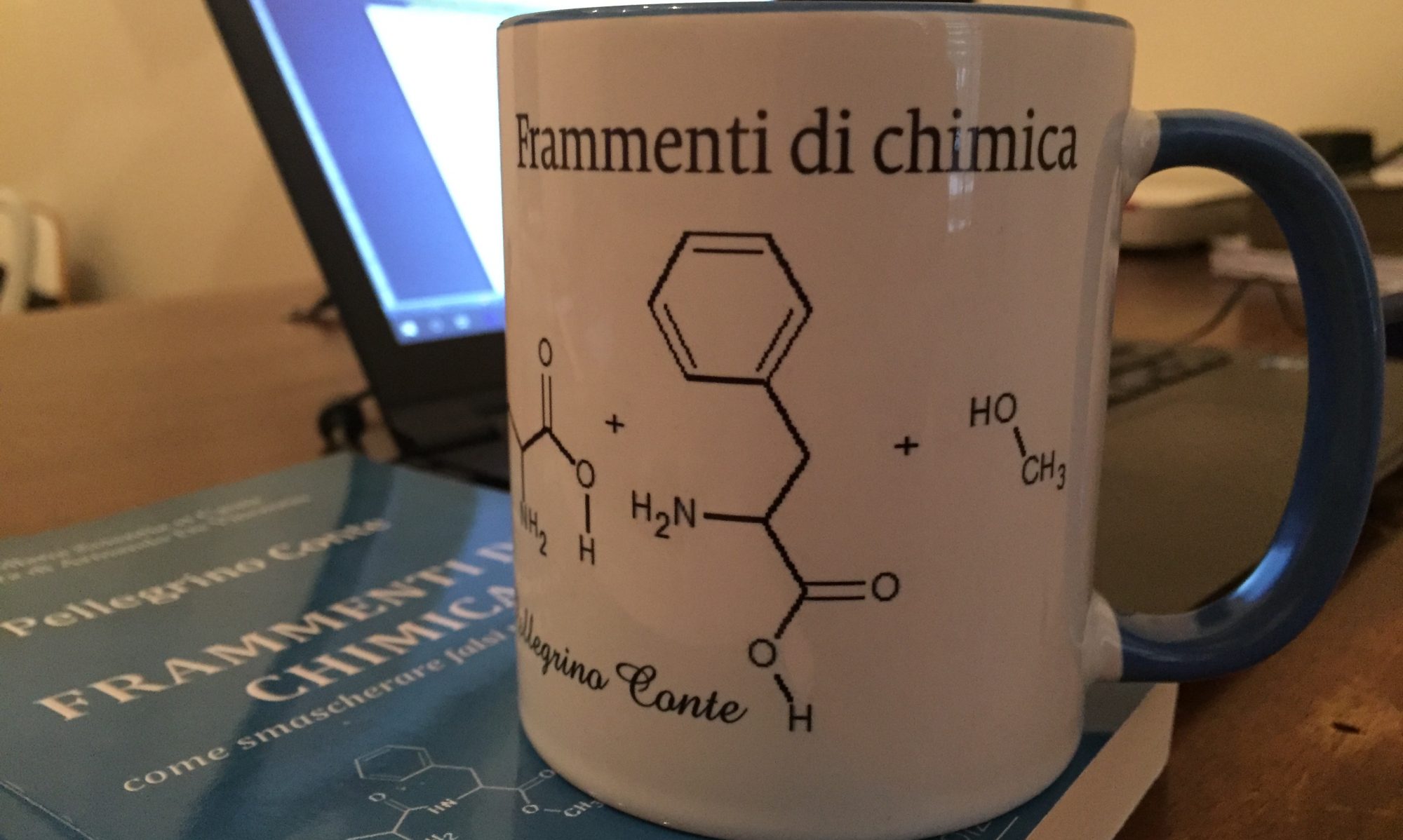

Fonte dell’immagine di copertina: http://www.metropolitanrisk.com/about-us/our-blog/7-common-commercial-insurance-myths

Non sono completamente d’accordo. Cito ” Il lavoro è stato pubblicato. È stato oggetto di revisione? Sì. Allora bene” . Ecco, per me è importante sapere la fonte/provenienza dei referees. Lo stesso articolo pubblicato sulla rivista A o sulla rivista B lo giudico diversamente se so che la rivista A è più o meno ufficialmente accreditata come seria, mentre la B pubblica anche la famosa lista della spesa.