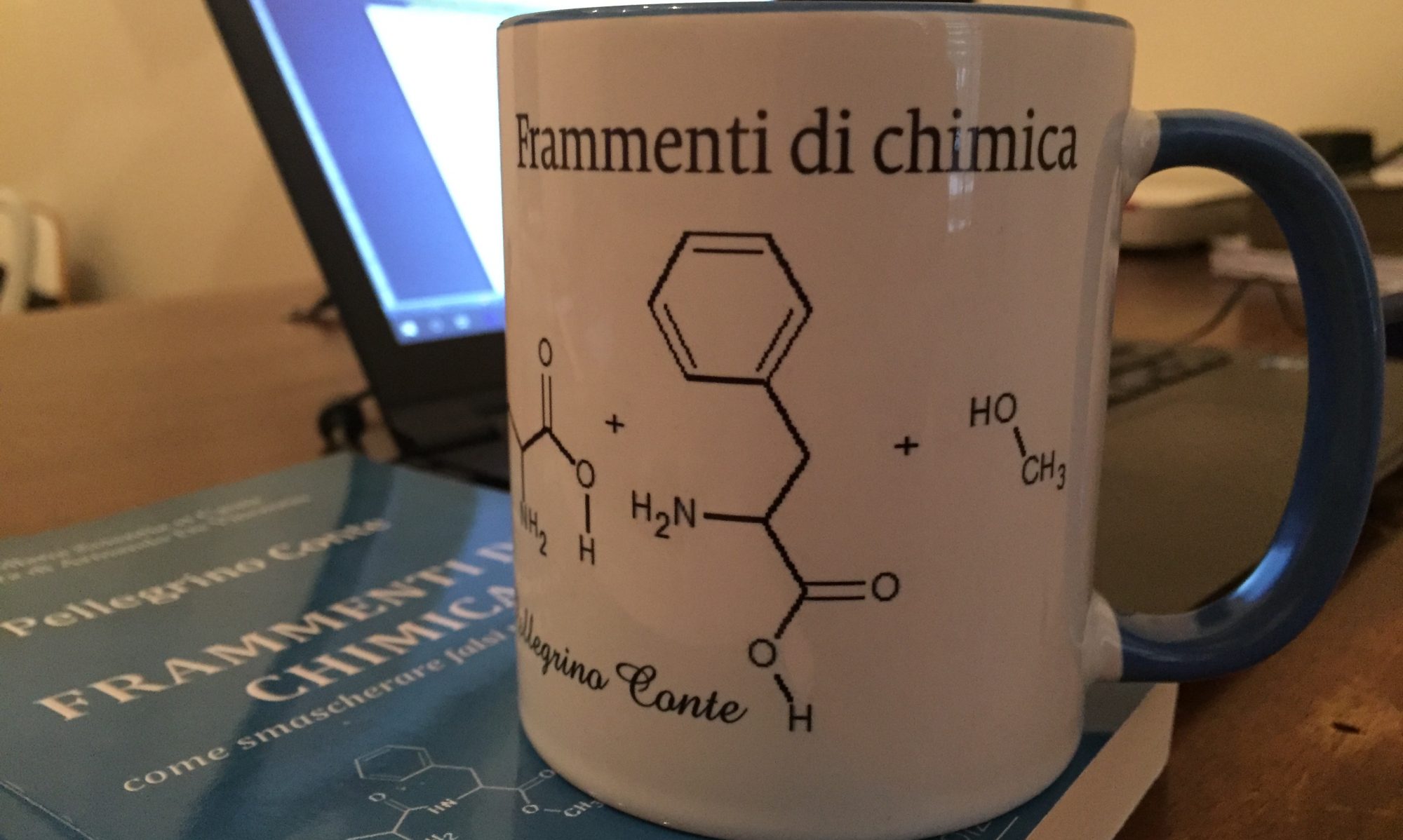

La ninidrina

A leggere il titolo di questo articolo vi starete chiedendo di cosa voglio parlare. Ebbene, di certo non voglio discutere di fantasy, né di una città esotica e nemmeno di un nuovo pianeta di un sistema solare lontano anni luce dal nostro.

Niente di tutto questo.

Mi è venuta voglia di descrivere la chimica di una molecola il cui funzionamento mi ha divertito ed appassionato moltissimo quando studiavo la biochimica nell’ormai lontano 1989. Poi vi dirò perché mi è venuta questa voglia.

La nomenclatura

La ninidrina ha nome IUPAC 2,2-diidrossi-1,3-diossoidrindene che, per i non chimici, non risolve alcun mistero. Anzi, volendo, lo complica ancora di più perché introduce una complessità maggiore nel dare un nome a qualcosa usando delle regole molto lontane dalla vita quotidiana. Potremmo pure chiamarlo tirannosauro cityplex, ma cambiare etichetta non permette di comprendere nulla in merito all’oggetto di cui voglio discutere.

Allora andiamo con ordine.

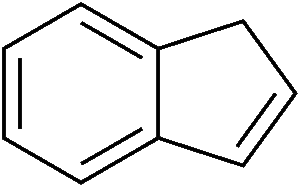

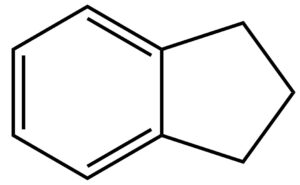

Partiamo dal termine indene.

L’indene è la molecola descritta qui sotto. Come si vede, si tratta di un composto formato da un anello benzenico (quello a sinistra, a 6 atomi di carbonio) fuso con un anello ciclopentadienico (quello a destra, a 5 atomi di carbonio). L’anello a 5 termini contiene un doppio legame: quello che vedete in basso a destra. In realtà, i doppi legami nel ciclo a 5 atomi di carbonio sono due, ma non voglio complicarvi ulteriormente la vita con formule ed ibridi di risonanza, per cui decido scientemente di commettere un errore.

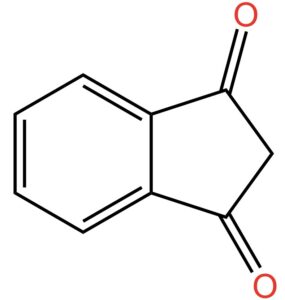

Se dall’anello a cinque atomi di carbonio togliamo quel doppio legame in basso a destra, otteniamo una molecola che si chiama idrindene la cui struttura è quindi:

Il doppio legame lo potete immaginare come un tavolo in cui ci sono due posti vuoti. Ci siete voi che aspettate due vostri amici: i fratelli gemelli idrogeno1 e idrogeno2. Quando arrivano, si siedono e la tavola è completa. Da un punto di vista chimico, togliere un doppio legame significa inserire due atomi di idrogeno, uno su ogni atomo di carbonio coinvolto nel doppio legame, mediante una reazione che si chiama idrogenazione. Il suffisso “idr” in idrindene, quindi, si riferisce proprio all’indene idrogenato.

A questo punto mettiamo due atomi di ossigeno legati ciascuno con doppio legame agli atomi di carbonio 1 e 3 come indicato nella figura qui sotto.

Ricordate una cosa importante: in chimica organica vengono attribuiti i numeri civici agli atomi di carbonio presenti in una molecola. Questi numeri civici, che vengono indicati come posizione degli atomi di carbonio all’interno della molecola, servono ai chimici per comprendere di quale atomo nello specifico si stia parlando. A questo punto, scegliete voi quale dei due atomi di carbonio sia 1 e quale 3. Però tranquilli perché non c’è nessuna risposta giusta o sbagliata: la molecola è simmetrica; quindi, potete ribaltarla come in uno specchio e tutto funziona allo stesso modo.

La reazione che produce questo oggetto chimico si chiama ossidazione, ma non importa il nome e proseguiamo. Andiamo avanti aggiungendo che i due gruppi ossigenati così ottenuti vengono indicati come “diosso”. Da qui il termine diossoidrindene. Ma dal momento che gli atomi di carbonio legati con doppio legame con l’ossigeno sono in posizione 1 e 3, il nome corretto è 1,3-diossoidrindene.

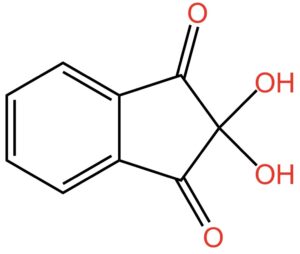

Continuiamo a mettere atomi di ossigeno e piazziamo due gruppi -OH, che si chiamano ossidrile oppure idrossile o, ancora, idrossi, sul carbonio in posizione 2. Otteniamo la struttura indicata nella seguente figura:

Poiché gli ossidrili in posizione 2 sono due, il nome dell’oggetto mostrato nella figura sopra diventa: 2,2-diidrossi-1,3-diossoidrindene… per gli amici intimi: ninidrina.

Quindi riassumendo

2,2-diidrossi è il suffisso che usiamo per indicare due gruppi -OH legati entrambi all’atomo di carbonio in posizione 2. Poiché gli ossidrili sono due, il numero civico del carbonio va ripetuto due volte mentre il suffisso “di” davanti a “idrossi” si riferisce proprio al numero di gruppi -OH presenti.

1,3-diosso è il suffisso che usiamo per indicare due atomi di ossigeno legati con doppio legame agli atomi di carbonio ai civici 1 e 3.

Il suffisso “idr” si riferisce a un sistema chimico che ha perso un doppio legame per effetto della reazione con idrogeno.

Infine, indene è la molecola da cui siamo partiti.

Ed ora?

Ed ora diamo un’occhiata al carbonio al civico 2 che è legato a due gruppi ossidrili.

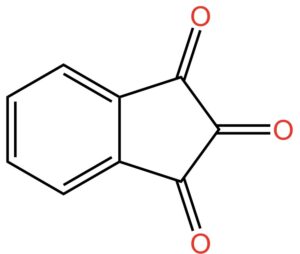

Dovete sapere che una molecola che contiene un gruppo ossidrile si chiama alcol. Sì… nel linguaggio comune il termine si riferisce all’ingrediente più importante di tante bevande: dal vino al bloody Mary, ovvero l’alcol etilico. Ma, in chimichese il termine alcol si riferisce a una classe di molecole che contengono il gruppo -OH. Quando nella stessa molecola sono presenti due gruppi ossidrili, questa viene indicata come diolo. Se i gruppi ossidrili sono sullo stesso atomo di carbonio, come nel caso della ninidrina, si parla di dioli geminali. Geminale deriva da gemello. I due -OH sullo stesso atomo di carbonio sono gemelli e come fratelli tendono a litigare. In effetti, i dioli geminali sono instabili perché i due gruppi -OH sullo stesso atomo di carbonio non stanno bene assieme e fanno a cazzotti. Cosa succede? Tendono a reagire per formare un doppio legame C=O in posizione 2, come nella figura qui sotto.

Adesso giochiamo ad aguzza la vista. Guardate cosa abbiamo combinato lì nella parte destra della molecola: ai civici da 1 a 3 ci sono tre gruppi C=O. Sembrano uguali, non è vero? Ma non è così.

Pur essendo uguali i tre gruppi hanno stabilità differente, o, potremmo anche dire, hanno reattività differente. In altre parole, tendono a reagire in modo diverso quando sono in presenza di particolari reagenti che andremo a vedere fra poco.

Il ruolo dell’elettronegatività

Il titolo di questo paragrafetto riporta una parolaccia: elettronegatività. Ma cos’è ‘sta roba?

Dobbiamo ricordarci che il chimichese è un linguaggio col proprio alfabeto e con le proprie regole di grammatica e sintassi. L’alfabeto è la tavola periodica. Essa contiene tutte le lettere, gli elementi chimici, che combinate formano le parole. Queste, a loro volta, messe assieme portano alle frasi chimiche che noi chimici ci ostiniamo a chiamare reazioni.

Sembra semplice, ma non lo è, purtroppo. E meno male… direi… altrimenti che ci sto a fare io qui?

Una delle regole grammaticali che a noi chimici piace utilizzare per spiegare cose che altrimenti sarebbero incomprensibili è l’elettronegatività. Il termine si riferisce alla tendenza di un elemento chimico a trattenere gli elettroni. Sì… proprio quegli affarini che si muovono intorno al nucleo secondo delle modalità che non ci è dato conoscere e che si presentano in delle regioni di spazio che amiamo definire col nome esotico di orbitali.

Più alta è la capacità di un elemento di trattenere gli elettroni, maggiore è il valore numerico dell’elettronegatività.

Sapete che il primo a quantificare l’elettronegatività è stato Linus Pauling? È uno dei miei idoli assieme a Richard Feynman. Li adoro entrambi.

Nella scala Pauling, l’elemento più elettronegativo è il fluoro (F), a seguire l’ossigeno. Solo molto dopo arriva il carbonio.

Quando scriviamo qualcosa come C-O, oppure C-H, stiamo riportando una interazione, che in chimichese si chiama legame, tra due elementi: carbonio e ossigeno, nel primo caso, carbonio e idrogeno, nel secondo.

Il trattino tra i due elementi è la rappresentazione grafica del legame chimico. Esso coinvolge due elettroni. In altre parole, il trattino sta a indicare due elettroni coinvolti nell’interazione tra gli elementi considerati.

Detto questo torniamo all’elettronegatività. Abbiamo detto che l’ossigeno è più elettronegativo del carbonio. Quindi, per effetto di questo, accade qualcosa di speciale nella distribuzione degli elettroni del legame C-O.

Siete curiosi di sapere cosa significa in un linguaggio meno chimichese?

Carbonio e ossigeno sono due persone. Il primo è un signore distinto col monocolo e il bastone; un signore d’altri tempi. Il secondo è un energumeno palestrato con la fissa per il wrestling. I due decidono di giocare al tiro alla fune. Chi vince secondo voi? Sì… l’energumeno palestrato.

Ecco… l’ossigeno, in virtù della sua maggiore elettronegatività, si comporta come il palestrato tirando verso di sé la corda con forza maggiore rispetto a quella usata dal signore di altri tempi. Ritornando al chimichese, gli elettroni del legame carbonio-ossigeno passano più tempo vicino a quest’ultimo che al carbonio. Nel linguaggio chimico più forbito, quello che userebbe il signore di altri tempi, la densità elettronica è spostata verso l’ossigeno. Questo vuol dire che, mediamente nel tempo, il carbonio è più elettropositivo dell’ossigeno. Scusate… traduco: per effetto della maggiore elettronegatività dell’ossigeno, il carbonio presenta una deficienza (nel senso di mancanza) elettronica ed ha una parziale carica positiva. Al contrario, l’ossigeno per gli stessi motivi ha una parziale carica negativa.

Adesso allarghiamo il campo. Se l’ossigeno richiama a sé gli elettroni del legame C-O, il carbonio, per effetto della sua deficienza elettronica, richiama a sé gli elettroni dei legami contigui. Quindi, se consideriamo qualcosa come C-C-O, anche il carbonio più lontano dall’ossigeno ha una parziale carica positiva indotta dal richiamo elettronico del lontano ossigeno.

Complichiamoci maggiormente l’esistenza e consideriamo un sistema come: O-C-C-C-O. Qui abbiamo tre atomi di carbonio e due di ossigeno. Gli atomi di carbonio alle estremità sono, ognuno, legati ad un atomo di ossigeno più elettronegativo. Questo vuol dire che il carbonio centrale risente del richiamo di due atomi di ossigeno. Come conseguenza, ha un potenziale elettropositivo (cioè una parziale carica positiva) maggiore rispetto al medesimo atomo di carbonio del sistema C-C-O.

Torniamo alla Ninidrina

Fatta la necessaria premessa sull’elettronegatività, riprendiamo la struttura della ninidrina in cui i due gruppi -OH hanno fatto a cazzotti. Per semplicità la riporto di nuovo qui di seguito:

Come vedete, abbiamo un C=O centrale, quello al civico 2, che risente dell’effetto dei due C=O al civico 1 e al civico 3. Pur avendo la stessa natura chimica, a causa degli effetti descritti prima, i C=O al civico 1 e 3 sono meno reattivi del C=O al civico 2. In pratica, la carica parziale netta positiva sul carbonio in 2 è maggiore rispetto a quelle degli atomi di carbonio in 1 e 3.

Cosa accade adesso?

Stiamo passeggiando nel parco. Stiamo per gli affari nostri quando incrociamo la nostra anima gemella: è amore a prima vista.

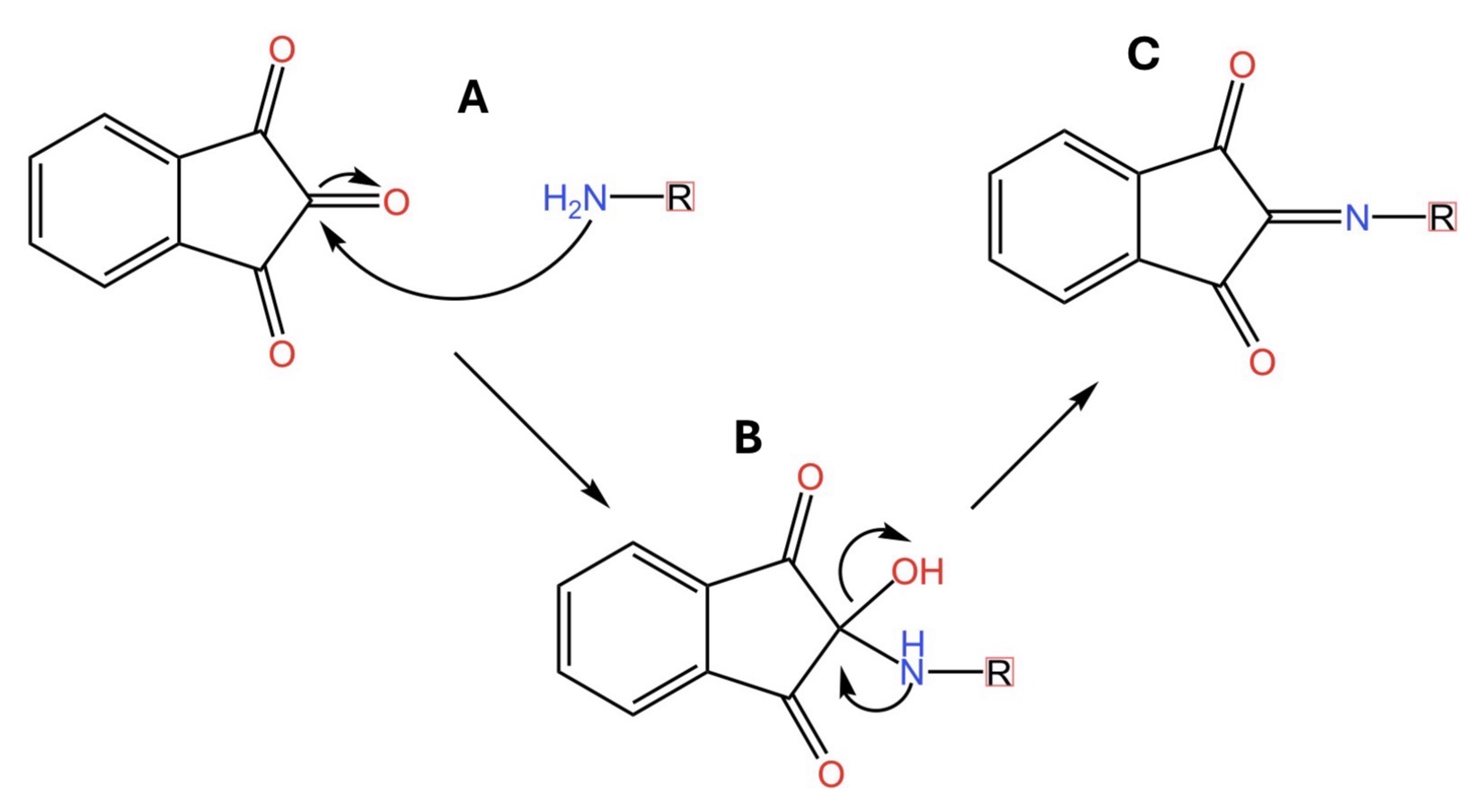

Ecco… il carbonio 2 della ninidrina povero di elettroni incrocia un sistema chimico che, invece, ne è ricco. Quale? Uno come R-NH2, per esempio. Questa è la formula generale dei composti che si chiamano ammine. L’azoto (N) è ricco di elettroni. Ne ha talmente tanti che quando si avvicina alla ninidrina viene attratto dalla sua anima gemella, ovvero il carbonio povero di elettroni in posizione 2. E cosa accade?

Guardate la figura qui sotto. In particolare la parte A. Qui le due anime gemelle si incontrano e si legano indissolubilmente. Le frecce curve indicano il movimento di elettroni dal sistema chimico che ne contiene di più a quello che ne contiene di meno. Si forma la molecola descritta nella parte B della medesima figura. In questa molecola intermedia, l’azoto è ancora ricco di elettroni. Di conseguenza li usa per rendere ancora più indissolubile il legame con la sua anima gemella portando alla formazione del composto riportato nella parte C della figura.

Sapete cosa è quella molecola? È un cromoforo, ovvero una molecola in grado di colorare di violetto una soluzione che la contiene. In altre parole, quando la ninidrina viene a contatto con una ammina o un altro sistema contenente un gruppo amminico, pensiamo, per esempio, agli amminoacidi, avviene una reazione che porta ad una soluzione colorata. L’intensità del colore è direttamente proporzionale alla quantità di sistema amminico che reagisce con la ninidrina. Nell’ambito della chimica biologica, la ninidrina è un utile strumento per quantificare gli amminoacidi con gruppi amminici primari (cioè del tipo RNH2) in sistemi proteici complessi.

La ninidrina nell’analisi forense

E veniamo al perché vi ho raccontato della ninidrina.

È da un po’ di tempo che si sente parlare del caso di Garlasco e dell’arresto quantomeno strano di Stasi. I diversi commentatori sui vari canali presenti in rete parlano ripetutamente di test della ninidrina per il rilievo delle impronte digitali. Ecco… ho l’impressione, ma è solo una mia opinione, che tutti parlino di qualcosa che non conoscono.

Cosa sono le impronte digitali? Si tratta di “immagini” dei nostri polpastrelli generate dal contatto con mezzi più o meno porosi. Da un punto di vista chimico, queste impronte contengono acqua, sali minerali, vitamine, amminoacidi e altro. Per il rilievo delle impronte si usa una soluzione di ninidrina che, reagendo con gli amminoacidi secondo lo schema appena descritto, produce un’immagine colorata che può essere studiata per consentire l’identificazione della persona che ha toccato quel dato oggetto.

Conclusioni

Perché la ninidrina mi divertiva quando studiavo la biochimica? Beh… da tutto quanto ho scritto è chiaro che conoscere la ninidrina significa avere in mente una quantità di conoscenze chimiche non indifferente. Non sto parlando solo della nomenclatura. Quella è una banalità. Bisogna avere conoscenze approfondite di chimica generale, chimica organica e quantomeccanica. Quello che vi ho raccontato non lo trovate scritto nei libri, ma lo ottenete dalla conoscenza comparata di diverse discipline chimiche. Ecco perché, quando sento qualcuno parlare della ninidrina come fosse un semplice reagente, sorrido. Per me è stata molto di più: è stata la prova che la chimica non è un insieme di nozioni, ma un modo di vedere il mondo. E quel viola, in provetta, era la conferma che avevo cominciato a vederlo davvero.

Grazie a tutti voi che avete avuto la pazienza di condividere con me un istante della mia vita da studente.

Aspasia e la fisica, ovvero come bevono i gatti

Avete mai avuto a che fare con quegli strani pelosetti, tenerissimi e convinti di essere i padroni della vostra vita? Sì, i gatti. Quegli esseri che fin dall’antico Egitto dominano l’umanità e che ai tempi dei faraoni erano considerati delle figure sacre. Io ne ho uno a casa… anzi una. Si chiama Aspasia. Ebbene sì, era il nome della compagna di Pericle, filosofa e intellettuale dell’antichità. E come la sua omonima, Aspasia la gatta, principessa dei croccantini, ha a che fare con la cultura. In che modo? Vi chiederete. Preparatevi qualcosa da bere, sedetevi comodi e cominciamo.

Avete mai visto come beve un cane? Il cane lappa, ovvero arrotola la lingua a formare una specie di cucchiaio, la immerge nell’acqua e tira su. Insomma, il cane lecca l’acqua. E questo oltre a fare rumore, sporca parecchio. Avevo un pastore belga che ogni volta che beveva faceva un lago.

Aspasia e i suoi simili, no. Niente risucchio, niente immersione del muso, niente rumori. Solo la lingua che tocca l’acqua e si ritrae con una velocità quasi innaturale. Il gatto “afferra” l’acqua sfruttando la fisica.

La lingua che solleva l’acqua

Quando un gatto beve, la punta della lingua tocca appena la superficie dell’acqua, senza immergersi. Subito dopo si ritrae rapidamente verso l’alto. Questo gesto crea una colonna d’acqua che segue la lingua per un istante, grazie a due forze fondamentali:

- inerzia (una volta messa in movimento dalla lingua, l’acqua tende a continuare a salire per un breve istante),

- tensione superficiale (le molecole restano “attaccate” tra loro).

Prima che la gravità faccia collassare la colonna, il gatto chiude la bocca e cattura l’acqua sospesa.

Tutto qui.

Elegante. Preciso. Fulmineo.

Un perfetto equilibrio tra tempo e gravità

La cosa sorprendente è che il gatto deve chiudere la bocca nel momento giusto.

Troppo presto → poca acqua.

Troppo tardi → la colonna collassa.

Le riprese ad alta velocità mostrano che un gatto domestico compie questo gesto 4–5 volte al secondo, sincronizzando:

- velocità della lingua,

- altezza della colonna d’acqua,

- tempo di chiusura della mandibola.

Non è istinto rozzo: è ottimizzazione dinamica. Questa sincronia porta alla formazione di una colonna d’acqua che si muove verso l’alto dalla ciotola alla bocca del gatto.

Perché i gatti bevono così (e i cani no)?

Il motivo è in parte anatomico, in parte evolutivo:

- i gatti hanno muso corto e denti affilati: immergere la bocca sarebbe scomodo,

- questo metodo permette di bere senza bagnarsi il naso (zona molto sensibile),

- la stessa tecnica è usata dai grandi felini: tigri, leoni, giaguari.

Un comportamento raffinato, ereditato da predatori che dovevano bere in fretta e con attenzione.

Un laboratorio di fisica… nella ciotola

Questo meccanismo è stato studiato con videocamere ad altissima velocità e modelli fisici che descrivono il bilancio tra:

- inerzia del fluido,

- gravità,

- frequenza di oscillazione della lingua.

In pratica, mentre il gatto beve, sta risolvendo (senza saperlo) un problema di meccanica dei fluidi non lineare.

Altro che “bere come un animale”.

La prossima volta che lo vedi bere…

…non pensare che stia semplicemente facendo il gatto. Sta usando una soluzione fisicamente elegante, raffinata e sorprendentemente efficiente.

Una lezione di scienza quotidiana servita in una ciotola d’acqua.

Riferimenti scientifici

- Articolo divulgativo (italiano)

La lingua del gatto e la meccanica dei fluidi, OggiScienza (2010). Link: https://oggiscienza.it/2010/11/12/la-lingua-del-gatto-e-la-meccanica-dei-fluidi/index.html

- Articolo scientifico originale

P. M. Reis, S. Jung, J. M. Aristoff, R. Stocker (2010). How Cats Lap: Water Uptake by Felis catus, Science, 330, 1231–1234. Link: https://www.science.org/doi/10.1126/science.1195421

Perché il burro è solido, l’olio è liquido e la margarina… dipende

La chimica nascosta dei gliceridi

A temperatura ambiente, il burro è compatto, l’olio scorre libero e la margarina sta nel mezzo: spalmabile, ma non liquida. La differenza non è (solo) nella provenienza animale o vegetale dei grassi. È soprattutto una questione di come i gliceridi si organizzano nello spazio. Dietro una noce di burro o un filo d’olio c’è una vera e propria architettura molecolare.

I protagonisti: gli acilgliceroli o gliceridi

Tutti e tre – burro, olio e margarina – sono costituiti principalmente da acilgliceroli: una molecola di glicerolo a cui sono legati uno, due o tre acidi grassi.

Il glicerolo è un triolo, cioè una molecola formata da tre atomi di carbonio, ad ognuno dei quali è legato un gruppo –OH, che si chiama ossidrile, tipico gruppo funzionale degli alcoli. Gli alcoli che contengono un solo gruppo ossidrile si chiamano semplicemente alcoli, quelli con due gruppi si dicono dioli, con tre trioli e così via.

Volendo fare una analogia con qualcosa con cui abbiamo a che fare tutti i giorni, pensiamo al glicerolo come a un manico con tre “attacchi”: se vuoi, come una forchetta con tre rebbi (tre punti disponibili per “agganciare” qualcosa).

A livello molecolare, quella “pasta” che infilziamo con la forchetta sono le molecole di acidi grassi. Gli acidi grassi sono sistemi chimici formati da una catena di atomi di carbonio; a un’estremità della catena c’è il gruppo carbossilico –COOH (o carbossile), in cui un carbonio è legato con doppio legame a un ossigeno e con legame singolo a un gruppo ossidrile.

Il gruppo carbossilico degli acidi grassi può legarsi a un gruppo ossidrile di un alcol per formare quello che si chiama estere. Quando l’alcol è un triolo come il glicerolo, i tre gruppi ossidrili si possono legare a uno, due o tre acidi grassi: si ottengono così i gliceridi o acilgliceroli.

– Se un solo acido grasso si lega al glicerolo si ottiene un monogliceride.

– Se sono due, un digliceride.

– Se sono tre, un trigliceride (più correttamente: triacilglicerolo).

La chiave della consistenza

Sulla base di queste premesse, possiamo dire che la chiave per comprendere la differenza tra burro, olio e margarina sta in:

– lunghezza delle catene

– grado di saturazione

– geometria (cis/trans)

– modo in cui queste molecole si impacchettano tra loro

Burro: ordine, cristalli e rigidità

Nel burro dominano acidi grassi più saturi, con catene relativamente lineari. E qui la faccenda diventa “materiale”: catene più dritte riescono ad avvicinarsi meglio, ad impacchettarsi e a formare cristalli. In pratica, molte molecole si allineano e costruiscono una rete solida.

Se ti piace restare sull’analogia della forchetta, possiamo dirla così (senza sbagliare): un triacilglicerolo è come un “manico” (glicerolo) con tre rebbi (tre catene). Nelle rappresentazioni si tende a immaginare una catena come “centrale” e due come “laterali”, ma i punti di attacco sono tre, e tutte e tre le catene contribuiscono al modo in cui la molecola si dispone e si avvicina alle altre.

Quando molte di queste molecole si trovano insieme, non è che si intrecciano davvero come forchette: quello che accade è che le catene sature, essendo più lineari, riescono a stare vicine e a massimizzare le interazioni deboli (le classiche interazioni di van der Waals). E quando questo “impacchettamento” diventa abbastanza regolare, nasce una fase cristallina: una micro-impalcatura che dà consistenza al burro.

Il risultato?

– una rete cristallina stabile

– un materiale solido ma fragile

– una consistenza che fonde rapidamente in bocca (intorno ai 32–34 °C)

Il burro, in definitiva, non è “duro” perché è freddo: è strutturato perché molte sue molecole possono stare insieme in modo ordinato.

Olio: disordine fluido

Nei gliceridi che compongono gli oli vegetali prevalgono acidi grassi insaturi, spesso con doppi legami in configurazione cis. Questa configurazione genera dei “gomiti” o “pieghe” che impediscono un impacchettamento regolare.

Le conseguenze sono:

– niente cristalli stabili (o molti meno, a temperatura ambiente)

– molecole che scorrono le une sulle altre

– stato liquido anche a basse temperature

L’olio è liquido perché non riesce a organizzarsi come il burro. Tuttavia, se la temperatura è sufficientemente bassa, anche questi gliceridi possono impacchettarsi abbastanza da formare cristalli e l’olio solidifica (e qui, infatti, diversi oli “velano” o solidificano a temperature diverse: dipende dalla composizione).

Margarina: l’arte dell’equilibrio

La margarina è un prodotto tecnologico, e lo è nel senso migliore del termine. È progettata per avere:

– una fase solida (cristalli di grasso)

– una fase liquida (oli non cristallizzati)

Il segreto sta nella cristallizzazione controllata dei gliceridi:

– scelta mirata degli acidi grassi

– raffreddamento e rimescolamento

– formazione di microcristalli che intrappolano l’olio

È una emulsione solida, non un semplice grasso.

Perché alcuni grassi sono più spalmabili (anche a parità di “ingredienti”)

Qui c’è un punto elegante: burro e margarina non sono “una sostanza”, ma una miscela di tantissimi triacilgliceroli diversi. Non tutti fondono alla stessa temperatura. Alcuni cristallizzano facilmente, altri restano fluidi.

Quindi, a una certa temperatura (per esempio quella della tua cucina), un grasso può contenere contemporaneamente:

– una frazione solida (microcristalli)

– una frazione liquida (olio intrappolato tra i cristalli)

La spalmabilità nasce proprio dal rapporto tra queste due frazioni: se la frazione solida è sufficiente a dare struttura ma non è troppa da irrigidire tutto, ottieni un materiale “plastico”, cioè modellabile e spalmabile. È il motivo per cui alcuni burri sono più “morbidi” di altri e perché la margarina può essere progettata per restare spalmabile anche appena uscita dal frigo.

Non solo chimica: la struttura si sente

Queste differenze molecolari diventano:

– spalmabilità

– resistenza al coltello

– sensazione in bocca

– comportamento in cottura

Quando diciamo che un burro “è plastico” o che una margarina “tiene la forma”, stiamo descrivendo una struttura molecolare, non un’opinione.

In cucina (e nel corpo) la chimica non mente

Capire come si organizzano i gliceridi ci ricorda una cosa semplice ma spesso dimenticata: gli alimenti non sono solo ingredienti, ma materiali complessi, con proprietà fisiche precise.

E ogni volta che spalmiamo del burro sul pane o versiamo dell’olio in padella, stiamo letteralmente maneggiando chimica allo stato solido e liquido.

Il destino della materia vivente: filosofia naturale delle trasformazioni

Quando faccio lezione mi accorgo spesso di una cosa: usiamo parole enormi con una naturalezza disarmante, come se fossero trasparenti. E invece no: dentro quelle parole ci sono scelte culturali, immagini implicite, scorciatoie del linguaggio.

Una delle più insidiose è “fertilità”. La diciamo e pensiamo subito a un raccolto più abbondante, a una resa migliore, a un suolo “che produce”. È una definizione comprensibile – ma è anche la più stretta, e in un certo senso la più povera.

Se vi capita di prendere in mano una zolla dopo una pioggia leggera, sentirne l’odore e vederne la grana, capite che non state toccando un semplice “supporto” per le radici. State tenendo tra le dita un sistema che respira, scambia, trattiene, rilascia: un’interfaccia fra roccia, acqua, aria e vita.

Fertilità

In ecologia e in scienza del suolo, la fertilità è soprattutto questo: la capacità di un suolo di sostenere reti di vita nel tempo, fornendo acqua, nutrienti, habitat, e un ambiente chimico-fisico in cui i processi biologici possono avvenire.

Detto così sembra astratto, ma ha una conseguenza importante: esistono suoli “fertili” anche dove non immaginiamo alcuna produttività agricola. I suoli desertici, le saline, i suoli polari o quelli sottilissimi su rocce giovani possono avere una fertilità minima e altamente specializzata – sufficiente però a sostenere comunità adattate a quelle condizioni estreme.

Non è romanticismo: è una questione di funzioni. Un suolo può essere povero di sostanza organica e tuttavia ospitare cicli del carbonio e dell’azoto; può avere pochissima acqua disponibile e tuttavia mantenere, per brevi finestre temporali, un’attività microbica sorprendente. La fertilità, in questo senso, è la misura della possibilità.

Cos’è la vita

Ed è qui che, di solito, faccio inciampare (con gentilezza) i miei studenti: “Cos’è la vita?”. Sembra una domanda scolastica, e proprio per questo le risposte arrivano spesso automatiche.

“La vita è la capacità di riprodursi”, dicono. Allora la domanda successiva è inevitabile: un mulo è vivo oppure no? Se lo è, la riproduzione non può essere il criterio decisivo.

“La vita è movimento, reazione, pensiero”. E allora che facciamo con una spora dormiente, con un seme in quiescenza, con un organismo in letargo? È vivo anche quando non ‘fa’ nulla di evidente. E un robot che si muove, reagisce e impara? Siamo tentati di chiamarlo vivo solo perché imita alcune proprietà del vivente.

Questi esempi servono a un punto semplice: la vita non risiede in una singola proprietà isolata. Il polmone da solo non è vivo. Il cuore da solo non è vivo. Neanche una molecola – per quanto sofisticata – è “viva” in sé. È soltanto quando molte parti diverse cooperano, in un equilibrio dinamico, che appare qualcosa di qualitativamente nuovo.

Vita come emergenza metabolica e autopoiesi

Se dovessi azzardare una definizione operativa, la formulerei così: la vita è una proprietà emergente che nasce dalla combinazione non lineare di molti fattori chimici e fisici, quando questi fattori si organizzano in una rete capace di mantenersi e rigenerarsi.

Il cuore di questa rete è il metabolismo: un intreccio di reazioni che trasforma materia ed energia e, soprattutto, mette in relazione fra loro metaboliti primari e secondari. I primi sono le “monete” fondamentali della cellula (zuccheri, amminoacidi, nucleotidi, lipidi); i secondi sono un immenso repertorio di molecole che modulano, proteggono, comunicano, competono, cooperano. Non sono accessori: spesso sono i nodi che rendono possibile l’adattamento, la regolazione, la risposta.

La cosa decisiva è l’intreccio: queste vie non scorrono in linea retta. Si parlano attraverso feedback, soglie, amplificazioni e smorzamenti. È una dinamica non lineare: piccole variazioni in un punto possono produrre grandi effetti altrove, e viceversa. Da questo tessuto di reazioni nasce la capacità di stare “lontano dall’equilibrio” senza collassare.

Quando questa rete metabolica sostiene un meccanismo autopoietico – cioè, quando il sistema produce e rinnova continuamente i propri componenti (membrane, enzimi, strutture), mantenendo un confine e una coerenza interna – allora riconosciamo il vivente. Non perché sia magico, ma perché ha una proprietà organizzativa che la pura chimica, lasciata a sé stessa, non mantiene a lungo.

Morte

La morte, vista così, è meno misteriosa di quanto sembri. Non è la fine della materia: è la fine di quell’organizzazione autopoietica.

Quando l’organizzazione si interrompe, cessa il controllo: i gradienti chimici si annullano, le membrane perdono integrità, i compartimenti cellulari si aprono. Le reazioni non si fermano: cambiano regime. Passano da un metabolismo regolato a una chimica di degradazione, guidata dalla termodinamica e facilitata da enzimi, idrolisi, ossidazioni, microbi.

Le molecole che fino a un istante prima partecipavano all’ordine interno dell’organismo non “muoiono”: tornano disponibili. Si spezzano, si dissolvono, si ricombinano. Rientrano nei cicli che attraversano suolo, aria e acqua.

Tre destini della materia organica

Qui vale la pena essere precisi, perché una semplificazione comune è pensare che tutto “torni subito in inorganico”. In realtà i destini sono almeno tre e hanno tempi molto diversi.

1) Mineralizzazione rapida. Una parte della materia organica viene degradata relativamente in fretta: carbonio che torna a CO₂, idrogeno che torna a H₂O, azoto che passa per ammonio e nitrati, zolfo che transita in forme ossidate o ridotte. È il flusso che alimenta gran parte del ciclo biogeochimico visibile.

2) Incorporazione e stabilizzazione. Un’altra parte non scompare: entra nella biomassa microbica e, soprattutto, nella cosiddetta necromassa microbica (i residui cellulari). Questi frammenti possono legarsi alle superfici minerali, essere protetti dentro aggregati, diventare meno accessibili agli enzimi. Qui il suolo funziona come archivio chimico-fisico: non per ‘mistero’, ma per protezione e limitazione della disponibilità.

3) Trasporto e trasformazioni lente. Una quota viene trasportata: disciolta nell’acqua, adsorbita a particelle fini, trascinata verso acque sotterranee o corsi d’acqua, o rilasciata come composti volatili. In questi percorsi può essere trasformata più volte, in modo discontinuo, con tempi che si allungano enormemente.

Queste tre strade coesistono. E la loro proporzione dipende da condizioni molto concrete: ossigeno, umidità, temperatura, tessitura, mineralogia, struttura degli aggregati, qualità della materia organica, comunità microbiche.

E il DNA?

Nella nostra immaginazione il DNA è “il codice”, la memoria più profonda della vita. Ma senza il contesto che lo mantiene – riparazione replicazione, protezione dentro strutture – anche quel codice si frammenta.

Questo non significa che non restino tracce: in certe condizioni parti di acidi nucleici possono persistere, essere adsorbite, essere rilevate a distanza di tempo. Ma la cosa importante è un’altra: l’informazione biologica non vive nei nucleotidi inerti; vive nel circuito che la interpreta e la rinnova.

Per questo la morte non è la scomparsa del materiale genetico in quanto materia, ma la perdita del sistema che lo rende funzione.

Il tempo del carbonio

La vita ha un tempo breve; la materia no. Un organismo può durare decenni, un ecosistema secoli, una specie milioni di anni. Gli atomi, invece, non hanno biografia: hanno traiettorie.

Gli atomi che oggi ci compongono arrivano da lontano: dalle piante che hanno fissato carbonio dall’atmosfera, dal suolo che ha trattenuto e trasformato residui, dall’acqua che ha sciolto e trasportato ioni, da catene alimentari e decomposizioni ripetute. In parte – su scale molto più grandi – vengono perfino da storie stellari.

E un domani, quando la trama che ci tiene insieme si allenterà, torneranno disponibili per altri sistemi. Non è una profezia numerica, è un modo probabilistico di guardare un ciclo globale: mescolamento e riuso rendono inevitabile che la materia passi attraverso molte forme. Su tempi lunghi, la possibilità cresce; non perché “debba”, ma perché può.

La continuità della materia non ci diminuisce. Ci colloca in un flusso più grande, in cui ogni configurazione è temporanea e tuttavia reale. La vita è una delle forme più straordinarie di questa temporaneità: ordine locale mantenuto consumando energia, nel corpo fragile di una rete metabolica.

Conclusioni

Se la vita è un’emergenza, allora i sistemi che la rendono possibile meritano un rispetto diverso: non come scenografia, ma come infrastruttura. Il suolo, l’acqua, l’aria – e le loro interazioni – sono i luoghi in cui la materia impara, per un attimo, a diventare organismo.

La materia non conosce finali: conosce trasformazioni. La vita è la fase in cui la materia trova voce, organizzazione, autoregolazione e poi la restituisce al flusso da cui proviene. E proprio perché è una parentesi, vale la pena guardarla senza slogan: con precisione, e con meraviglia.

“Lo dice la scienza”: un caso studio sul confine fra metodo scientifico e decisioni normative

Introduzione

Qualche giorno fa ho pubblicato un breve articolo [link] in cui riflettevo sull’uso sempre più frequente della locuzione “lo dice la scienza” nella divulgazione scientifica. Ho notato come molte riviste accreditate e numerosi divulgatori ricorrano a questa espressione per rafforzare le conclusioni dei propri ragionamenti.

In quell’articolo evidenziavo come tale locuzione sia problematica sia sul piano dei contenuti sia su quello della comunicazione: la scienza non è un soggetto che parla, non produce verità assolute e non funziona per atti di fede.

A seguito della pubblicazione, si è sviluppata una discussione pubblica con un lettore (Figura 1) che rappresenta un caso interessante di fraintendimento del confine fra metodo scientifico e decisioni normative. È questo scambio, più che le persone coinvolte, a costituire l’oggetto dell’analisi che segue.

Figura 1. Estratto di uno scambio pubblico avvenuto nei commenti a un articolo precedente. Il dialogo è riportato come caso studio per illustrare alcuni fraintendimenti ricorrenti nel dibattito pubblico sul rapporto fra metodo scientifico e decisioni normative. Lo scopo non è valutare le persone coinvolte, ma analizzare gli argomenti e i passaggi concettuali.

Il metodo scientifico non “impone” nulla

Uno degli equivoci più ricorrenti nel dibattito pubblico consiste nel trattare la scienza come un’autorità normativa, capace di imporre comportamenti, obblighi o divieti. Ma il metodo scientifico non ha questo ruolo.

La scienza:

- formula ipotesi,

- raccoglie dati,

- costruisce modelli,

- li testa e li migliora.

Non decide cosa si deve fare.

Le decisioni — sanitarie, politiche, sociali — sono sempre atti normativi, presi da istituzioni e governi sulla base delle evidenze disponibili, ma anche di valutazioni etiche, economiche e sociali.

Confondere questi due piani significa attribuire alla scienza un potere che non ha, e allo stesso tempo criticarla per responsabilità che non le competono.

Il dubbio scientifico non è sospensione permanente del giudizio

Un secondo elemento che emerge chiaramente dal caso studio è l’uso improprio del concetto di dubbio. Nel linguaggio scientifico, il dubbio non è sinonimo di paralisi o relativismo.

Il dubbio scientifico serve a:

- migliorare i modelli,

- individuare limiti,

- integrare nuovi dati.

Non serve a rinviare indefinitamente ogni decisione in attesa di una verità finale e immutabile. In contesti reali, non decidere è comunque una scelta, con conseguenze misurabili.

Il fatto che la scienza evolva nel tempo non implica che “tutto sia ugualmente vero” in ogni momento. Implica, piuttosto, che le decisioni vengono prese con le migliori conoscenze disponibili in quel momento, sapendo che potranno essere aggiornate.

Quando il metodo scientifico viene trattato come ideologia

Nel botta e risposta riportato in Figura 1 compare anche un altro fraintendimento tipico: l’idea che difendere il metodo scientifico significhi trasformarlo in una sorta di religione laica, intollerante al dissenso.

In realtà accade spesso l’opposto:

chi riduce la scienza a un dogma finisce per trattarla come un’ideologia, mentre chi la riduce a una semplice opinione finisce per svuotarla di significato.

Il metodo scientifico non è né una fede né un’opinione. È uno strumento critico, fallibile e autocorrettivo. Ed è proprio questa sua natura a renderlo affidabile.

Perché questo caso è esemplare

Lo scambio riportato non è un’eccezione. È rappresentativo di un modo molto diffuso di discutere di scienza nello spazio pubblico, in cui:

- il metodo scientifico viene confuso con le sue applicazioni normative;

- il dubbio viene usato come scudo retorico, non come strumento di analisi;

- l’evoluzione delle conoscenze viene interpretata come prova di arbitrarietà.

Analizzare casi concreti come questo è utile non per “avere ragione”, ma per chiarire dove avviene lo slittamento concettuale.

Conclusione

Dire “lo dice la scienza” è una scorciatoia comunicativa che finisce per alimentare proprio i fraintendimenti che vorrebbe evitare. La scienza non parla, non impone e non promette certezze assolute. Fornisce strumenti per comprendere la realtà e basi razionali su cui costruire decisioni collettive.

Confondere questi piani non rafforza la scienza: la indebolisce.

Ed è solo mantenendo chiaro il confine fra metodo scientifico e decisioni normative che il dibattito pubblico può tornare ad essere, davvero, razionale.

“Lo dice la scienza”: come sbagliare nella divulgazione scientifica.

Sempre più spesso mi capita di leggere articoli di divulgazione scientifica che iniziano con una frase che mi fa rabbrividire: “Lo dice la scienza”.

È una frase apparentemente rassicurante, che suona razionale, moderna, definitiva.

Eppure, è una frase profondamente sbagliata – non per cavilli linguistici, ma perché travisando la natura della scienza finisce per indebolirla.

Vediamo perché.

La scienza non è un soggetto che parla

La scienza non è una persona, né un’istituzione che emette verdetti.

Non “dice” nulla nel senso in cui parlano un giudice, un prete o un politico.

La scienza è un metodo:

- per formulare ipotesi,

- raccogliere dati,

- costruire modelli,

- testarli,

- correggerli o abbandonarli.

Quando diciamo “lo dice la scienza”, stiamo facendo una personificazione indebita, come se esistesse una voce unica e autorevole che pronuncia sentenze.

In realtà parlano gli scienziati, i dati, gli esperimenti, le analisi statistiche — e lo fanno con gradi diversi di incertezza.

La scienza non produce verità assolute

Uno degli errori più gravi contenuti in quella formula è l’idea implicita che la scienza fornisca verità definitive.

Ma la scienza funziona esattamente al contrario:

- ogni risultato è provvisorio,

- valido entro un certo contesto,

- sempre aperto a revisione.

Quando dici “lo dice la scienza”, stai in realtà dicendo: “Questa affermazione non è discutibile”. Ed è una frase anti-scientifica.

Tradizione filosofica e scienza

Per secoli la tradizione filosofica ha difeso la visione geocentrica dell’universo, ovvero che la Terra fosse al centro dell’universo.

Poi arrivò Galileo Galilei, con osservazioni empiriche che non tornavano.

Non vinse perché “aveva fede”, ma perché:

- mostrò dati,

- li rese pubblici,

- accettò il confronto (anche quando era rischioso).

Più tardi, Isaac Newton formulò leggi che sembravano descrivere l’universo in modo definitivo. E per due secoli la scienza diceva che fossero esatte.

Finché non arrivò Einstein.

Nel mondo scientifico si cambia spesso idea, ma non per capriccio, semplicemente perché funziona così: nuovi dati e nuove esperienze permettono di migliorare i modelli presenti per spiegare nuove osservazioni e superare i limiti di quelli precedenti.

“Lo dice la scienza” è un argomento ad autoritatem mascherato

Usare questa formula nel dibattito pubblico equivale spesso a dire:

- “Non discutere”

- “Non fare domande”

- “Fidati e basta”

È lo stesso meccanismo retorico di:

- “Lo dice la Chiesa”

- “Lo dice la Legge”

- “Lo dice l’esperto”

Ma la scienza non chiede fiducia cieca.

Chiede:

- controllo,

- replicabilità,

- spirito critico.

Quando diventa un’autorità indiscutibile, smette di essere scienza e diventa scientismo.

Cancella il dissenso scientifico

In quasi tutti i campi reali della ricerca:

- esistono risultati non perfettamente concordi,

- modelli alternativi,

- interpretazioni diverse degli stessi dati.

Dire “lo dice la scienza” al singolare:

- fa sparire il dibattito,

- delegittima il dissenso onesto,

- confonde il pubblico.

Il dissenso non è un difetto della scienza: è il suo motore. Ma l’errore non è solo concettuale. È anche comunicativo.

È comunicativamente controproducente

Paradossalmente, questa formula:

- rafforza chi già diffida della scienza,

- fa sembrare il metodo scientifico una nuova religione,

- allontana chi vorrebbe capire, non credere.

Chi sente “lo dice la scienza” spesso pensa: “non posso fare domande, allora non è scienza.” Ed è una reazione comprensibile.

Come dirlo meglio

Esistono alternative molto più corrette e anche più oneste:

- “I dati disponibili indicano che…”

- “Secondo le evidenze sperimentali attuali…”

- “Nel quadro teorico oggi più robusto…”

- “La maggior parte degli studi converge su…”

- “Con le conoscenze attuali, questo è il modello migliore”

Sono frasi meno perentorie, ma più forti, perché non fingono certezze che la scienza non promette.

Conclusione

Dire “lo dice la scienza” è sbagliato perché trasforma un metodo critico, fallibile e dinamico in un’autorità dogmatica.

La scienza non ha bisogno di essere difesa come un dogma.

Ha bisogno di essere capita. Ed è solo quando la raccontiamo per ciò che è – uno strumento imperfetto ma potentissimo – che può davvero aiutare la società a prendere decisioni migliori.

Quando la combustione non è combustione

Del perché l’ATP non è energia e quali sono gli equivoci più diffusi sul metabolismo

Qualche tempo fa mi è capitato di scrivere una risposta un po’ “di getto” a un post di un qualche professionista che aveva super-semplificato concetti biochimici abbastanza complessi. Onestamente, non ricordo nemmeno più di cosa si parlasse. Rileggendo la mia risposta, che avevo scritto e conservato nelle note del mio iPad, mi è venuta voglia di riprendere alcuni concetti e scrivere un articolo per il blog. Questo perché l’equivoco è diffusissimo e riguarda due parole che usiamo con troppa disinvoltura: combustione ed energia.

Ogni tanto, nei commenti e nei post divulgativi, ricompare un’idea seducente perché è semplice: “nel corpo bruciamo zuccheri e grassi, quindi è combustione”. Il problema è che, presa alla lettera, questa metafora non chiarisce: confonde.

Nel nostro metabolismo non c’è nessuna fiamma. C’è invece una sequenza finissima di reazioni di ossidoriduzione mediate da enzimi, progettata per estrarre energia a piccoli passi, conservarne una parte e spenderla dove serve. È proprio questa regia molecolare – lenta, selettiva, controllata – a rendere possibile la vita.

Metabolismo ≠ combustione (anche se alla fine escono CO₂ e H₂O)

La combustione è, idealmente, una reazione rapida e poco controllata, che dissipa energia soprattutto come calore e luce. Il metabolismo aerobico fa l’opposto: smonta le molecole in modo ordinato e progressivo “raccogliendo” energia in intermedi chimici.

Il ciclo dell’acido citrico (o ciclo di Krebs), per esempio, non è una specie di fornace che “produce energia” nel senso comune. Il suo compito principale è generare carrier ridotti (NADH, FADH₂) e un equivalente di ATP (GTP/ATP) per giro: elettroni “ad alto potenziale”1 che verranno poi convertiti in ATP tramite la respirazione mitocondriale. In pratica, NADH e FADH₂ cedono elettroni alla catena di trasporto degli elettroni nella membrana mitocondriale interna; l’energia liberata pompa H⁺ creando un gradiente protonico, che l’ATP-sintasi (un enzima) usa per produrre ATP.

Per ogni acetil-CoA, il bilancio classico è:

- 3 NADH

- 1 FADH₂

- 1 GTP (o ATP equivalente)

- 2 CO₂

“Energia chimica”: la scorciatoia dei “legami” e la parola giusta

A questo punto arriva spesso un secondo equivoco: “l’energia è contenuta nei legami chimici”. È una scorciatoia linguistica che può funzionare in una spiegazione rapida, ma rischia di piantare in testa un’idea sbagliata: l’energia non è un contenuto nascosto nel singolo legame, pronto a uscire quando lo rompi. Rompere legami costa energia; formare legami libera energia. Quello che conta è la differenza complessiva tra reagenti e prodotti.

Se vogliamo dirla pulita (senza “chimichese” inutile): la grandezza che interessa davvero, quando parliamo di “energia spendibile”, è l’energia libera di Gibbs. È lì che sta il significato operativo di “questa reazione può trainarne un’altra”.

ATP: non “energia”, ma un “vettore” di energia libera

Qui sta il nodo: ATP è una molecola, non una forma di energia. Ciò che ha significato fisico è la variazione di energia libera associata alla sua idrolisi: in condizioni standard biochimiche (ΔG°′) per ATP → ADP + Pi è circa −30.5 kJ/mol (≈ −7.3 kcal/mol).

Detto senza slogan: la cellula usa ATP come intermedio operativo per accoppiare reazioni che liberano energia (ossidazioni metaboliche) a reazioni che ne richiedono (biosintesi, trasporto attivo, contrazione muscolare). ATP non “è” energia: è uno strumento chimico che permette all’energia libera di essere trasferita e spesa in modo controllato.

Calorie, Joule e “energia degli alimenti”: misura diretta o equivalente?

Il Joule (J) è l’unità SI dell’energia. La caloria è un’unità storica ancora comunissima: nella definizione termochimica 1 cal = 4.184 J.

In nutrizione, poi, la trappola è linguistica: la “Caloria” dei cibi (spesso con la C maiuscola) è in realtà una kilocaloria: 1 Cal = 1 kcal = 1000 cal.

Quando diciamo che un alimento “apporta energia”, spesso ci riferiamo a un valore ricavato (storicamente) dalla calorimetria a combustione: bruci il campione e misuri il calore prodotto. È un modo standardizzato e utile, ma va letto per quello che è: un valore equivalente, non la descrizione letterale di ciò che avviene nel corpo.

In questo senso, il meccanismo è simile a un’abitudine ben nota in chimica analitica e agronomia: quando in etichetta trovi il potassio espresso come K₂O, non significa che nel fertilizzante ci sia davvero ossido di potassio; significa che il contenuto è riportato come equivalente convenzionale. Allo stesso modo, il “potere calorico” è un modo coerente per comparare contenuti energetici, ma non autorizza a immaginare la fisiologia come una combustione “a fiamma”.

“Metabolismo lento”: una frase comoda, ma chimicamente vuota

Un inciso necessario, perché qui si inciampa spesso: “ho il metabolismo lento”. La frase è diffusissima, e non la usano solo i profani: la usano anche alcuni nutrizionisti. Il problema è che, sotto il profilo chimico, detta così non significa nulla. “Metabolismo” non è una singola reazione con una velocità, ma un insieme enorme di vie e processi; “lento” rispetto a quale variabile? Con quale unità? Con quale condizione iniziale?

Se vogliamo parlare in modo serio, dobbiamo dire cosa intendiamo davvero: di solito si sta parlando della spesa energetica (quanta energia l’organismo consuma per unità di tempo), cioè di un flusso misurabile. In quel caso non serve la metafora: si dice metabolismo basale (BMR) o spesa energetica a riposo (REE), e si ragiona su cosa la fa variare: massa magra, età, sesso, stato ormonale, temperatura corporea, attività del sistema nervoso simpatico, ecc. Ma chiamarlo “metabolismo lento” è un modo pigro di mettere un’etichetta a un risultato (consumo più basso del previsto) senza dichiarare il parametro, la misura e il confronto.

In breve: “metabolismo lento” è una frase che suona scientifica, ma spesso è solo un modo per evitare la parte scientifica.

In pratica, cosa intendono davvero quando dicono “metabolismo lento”

Quasi sempre, dietro quella formula ci sono una (o più) di queste cose:

- Metabolismo basale più basso del previsto (BMR/REE). Non perché le reazioni “vadano piano” in senso chimico, ma perché il “motore minimo” dell’organismo è proporzionato soprattutto alla massa metabolicamente attiva (in primis la massa magra) e a fattori fisiologici (età, ormoni tiroidei, stato infiammatorio, ecc.). Qui “lento” è solo un aggettivo messo al posto di un numero.

- NEAT basso: il consumo che non si vede. C’è una quota enorme di dispendio energetico che non è “sport”: è movimento spontaneo, postura, gesticolazione, irrequietezza, camminate, scale, micro-attività quotidiane. Se questa quota cala, la persona “consuma meno” senza accorgersene. E il mito del metabolismo lento diventa il cappotto perfetto per coprire un cambiamento di comportamento.

- Adattamento energetico durante diete restrittive. Quando l’introito calorico scende molto e a lungo, il corpo tende a ridurre alcuni consumi (anche tramite variazioni ormonali e riduzione di NEAT). Non è magia, non è “metabolismo che si rompe”: è fisiologia prevedibile. Chiamarlo “metabolismo lento” è un modo furbo per evitare la frase corretta: sto spendendo meno energia per unità di tempo rispetto a prima.

- Confronti sbagliati e misure fantasiose. Molte “diagnosi” di metabolismo lento nascono da confronti senza metodo (tabelle generiche, smart-watch, stime grossolane, “calorie bruciate” sparate). Se il dato di partenza è rumoroso, la conclusione è narrativa.

“Metabolismo lento” è spesso un’etichetta che suona scientifica proprio perché non dice nulla di misurabile. Quando mancano parametri e unità, il linguaggio riempie il vuoto con metafore: ATP diventa “energia”, la respirazione cellulare diventa “combustione”. Ma così non si semplifica: si mescolano categorie diverse, e il risultato è un corto circuito linguistico che produce solo una cosa… altra confusione.

Semplificare sì, vendere fumo no

Semplificare è necessario. Ma esiste un punto preciso in cui la semplificazione smette di essere didattica e diventa errore travestito da chiarezza: quando parole grandi (“energia”, “combustione”, “umiltà”, “scienza”) vengono usate come scenografia, al posto dei concetti che fanno davvero funzionare la spiegazione (redox, ΔG, unità di misura, condizioni standard vs condizioni cellulari).

E qui la faccio secca: se uno scambia ATP per “energia”, non sta semplificando, sta sbagliando oggetto grammaticale e oggetto scientifico nello stesso colpo. È come discutere di temperatura e confondere il termometro con i gradi: poi puoi anche metterci sopra parole solenni, ma resta un errore di base.

L’umiltà scientifica non è dire “parliamo semplice” e poi pretendere che la realtà si adatti alla frase. È accettare che la realtà sia più strutturata, e che le metafore, quando diventano troppo comode, non illuminano: addormentano.

In breve: la divulgazione non deve essere un caminetto acceso. Deve essere una lente pulita. E quando la lente è sporca di slogan, l’unica cosa che si vede bene è lo slogan.

Glossario degli acronimi

BMR – Basal Metabolic Rate (o metabolismo basale). Rappresenta la spesa energetica minima necessaria a mantenere le funzioni vitali a riposo.

NEAT – Non-Exercise Activity Thermogenesis. È il dispendio energetico dovuto ad attività non sportive (movimento spontaneo, postura, ecc.).

REE – Resting Energy Expenditure (o spesa energetica a riposo). Rappresenta la spesa energetica a riposo, spesso usata in clinica/nutrizione.

SI – Sistema internazionale

Sigle e simboli

ADP – Adenosine diphosphate (adenosina difosfato). Prodotto dell’idrolisi dell’ATP.

ATP – Adenosine triphosphate (adenosina trifosfato). Molecola “intermedia” usata per trasferire energia libera tra reazioni.

CO₂ – Anidride carbonica. Prodotto finale dell’ossidazione completa del carbonio organico nel metabolismo aerobico.

FADH₂ – Flavin adenine dinucleotide (forma ridotta). Trasportatore di elettroni/protoni prodotto in alcune tappe metaboliche.

GTP – Guanosine triphosphate (guanosina trifosfato). Nucleotide energetico “equivalente” all’ATP in alcune reazioni.

NADH – Nicotinamide adenine dinucleotide (forma ridotta). Trasportatore di elettroni/protoni prodotto da molte ossidazioni metaboliche.

Pi – Inorganic phosphate (fosfato inorganico). Prodotto dell’idrolisi dell’ATP insieme ad ADP.

Note

1 ↩︎ Quando dico che NADH e FADH₂ “portano elettroni ad alto potenziale”, non intendo un misterioso superpotere degli elettroni. È un modo compatto per dire questo: quegli elettroni sono in una condizione energetica tale da poter “scendere di livello”, passando a un accettore più “affamato” di elettroni (come l’ossigeno), e in quella discesa liberano energia utilizzabile.

In termini più rigorosi, “alto potenziale” significa che la coppia redox (per esempio NADH/NAD⁺) ha una forte tendenza a donare elettroni a coppie redox con potenziale più alto (più ossidanti). La catena respiratoria non fa altro che gestire questa discesa a tappe: ogni trasferimento libera un po’ di energia, e quella energia viene usata per pompare H⁺ e costruire il gradiente protonico che alimenta l’ATP-sintasi.

Usando un’immagine mentale: non è una “combustione”, è più simile a una centrale idroelettrica. Gli elettroni sono l’acqua in quota: non “sono energia”, ma hanno la possibilità di cadere e far funzionare una turbina (qui: pompaggio di H⁺ e sintesi di ATP).

L’ombra della fiamma di una candela

Ovvero: quando la semplificazione diventa… troppo semplice

Come sapete, miei cari e fedeli lettori, mi piace fare divulgazione scientifica.

Affronto argomenti molto svariati con una particolare predilezione per la chimica, che è la disciplina in cui sono specializzato.

Una cosa che devo puntualizzare è che nel fare divulgazione cerco sempre di semplificare per rendere digeribili concetti difficili anche a chi non ha una preparazione tecnica.

Molte volte ci riesco. Tante altre – la maggioranza, temo – non ce la faccio.

Per imparare a fare divulgazione seguo tanti canali, uno dei quali è Geopop, famoso per la semplicità con cui riesce a spiegare le cose.

Purtroppo, però, la semplificazione estrema a volte porta a dire inesattezze.

In un recente filmatino (lo trovate qui) hanno affrontato un argomento curioso: la fiamma di una candela non proietta alcuna ombra.

Devo dire che non mi ero mai posto il problema e, quando ho cominciato a guardare il video, mi sono incuriosito per capire come avrebbero spiegato la cosa.

Sono rimasto a bocca aperta quando ho sentito che la fiamma di una candela sarebbe un plasma.

La bassa densità di questo presunto plasma, secondo il video, lascerebbe passare indisturbati i fotoni della luce che, così, non verrebbero né deviati né riflessi: condizione necessaria per proiettare un’ombra.

Ora, perché sono rimasto a bocca aperta?

Semplicemente perché la fiamma di una candela non è affatto un plasma.

Cos’è davvero un plasma?

In fisica-chimica il plasma è considerato il quarto stato della materia, assieme a solido, liquido e gas.

È un gas talmente caldo (o energizzato) da risultare fortemente ionizzato: ioni positivi, elettroni liberi, particelle cariche che rispondono a campi elettrici e magnetici.

Per capirci:

- i fulmini sono plasmi;

- il Sole è plasma;

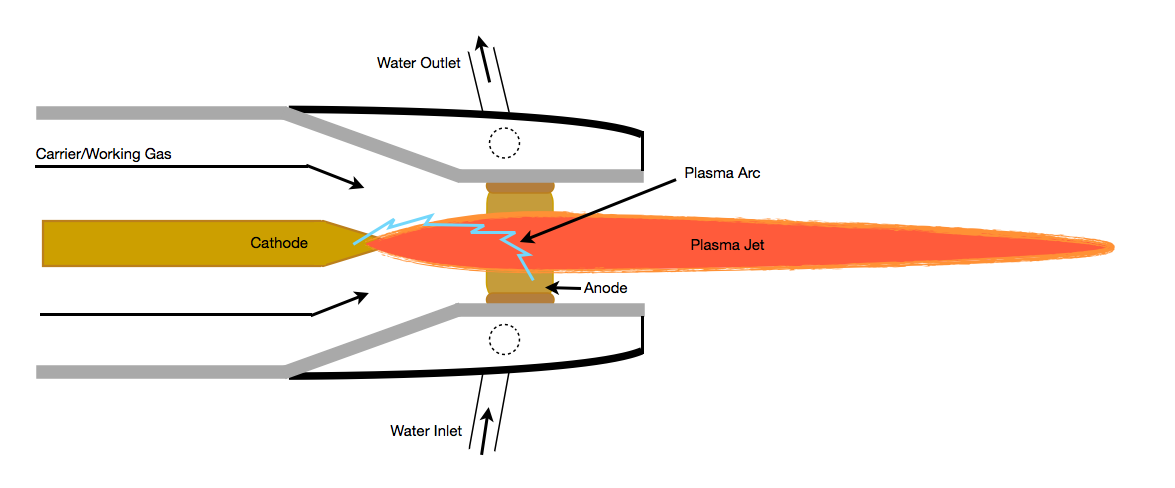

Le torce al plasma (Figura 1) sono progettate apposta per raggiungere temperature elevatissime.

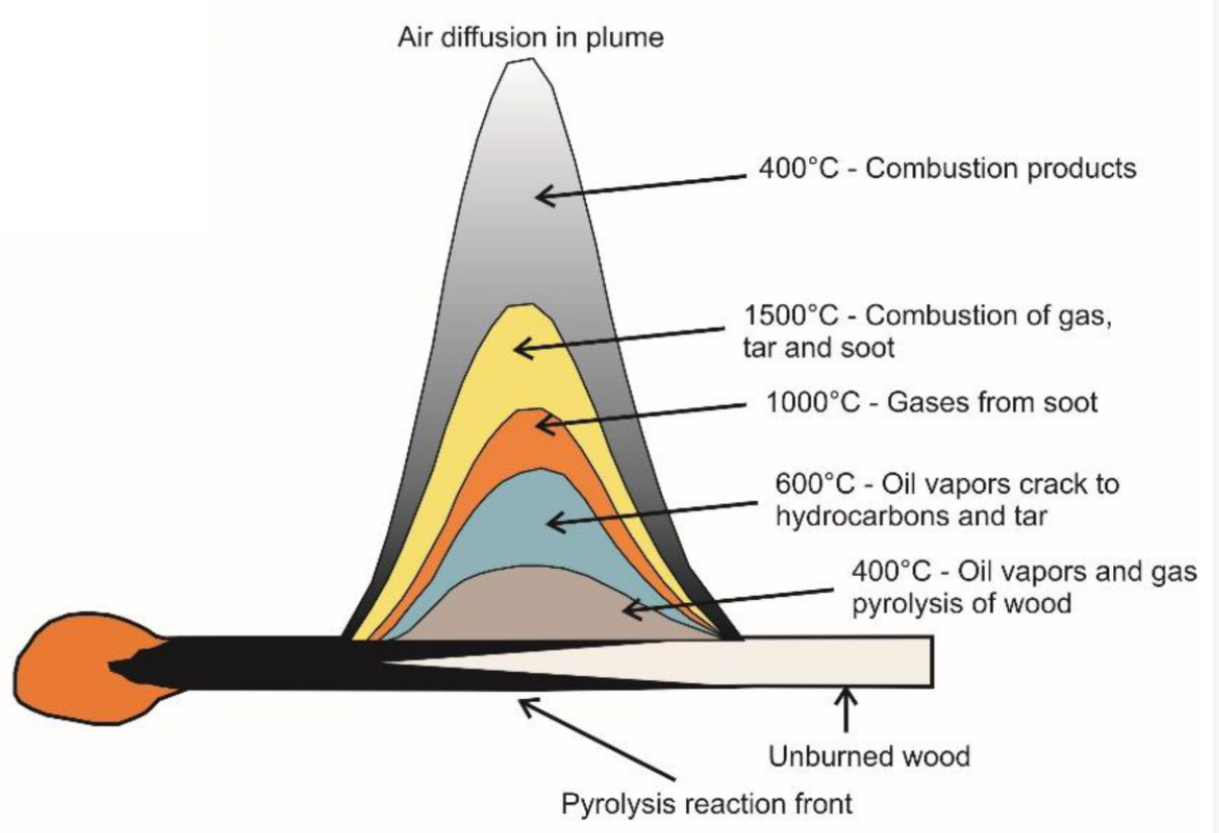

La fiamma di una candela, invece, raggiunge temperature massime dell’ordine di 1000–1500 °C (Figura 2).

Sono temperature più che sufficienti per la combustione, ma troppo basse per generare una ionizzazione significativa.

Certo, nella fiamma troviamo radicali e qualche ione fugace (H⁺, O⁻, CHO·, ecc.), prodotti naturali della combustione: ma la loro concentrazione è minima, del tutto insufficiente per parlare di plasma.

In altre parole: niente plasma, almeno non nel senso fisico-scientifico del termine.

Ma allora perché la fiamma non fa ombra?

Per capire il motivo reale, basta ricordare che un oggetto proietta ombra solo se:

- assorbe la luce;

- la riflette;

- oppure la diffonde in modo significativo.

Una fiamma è invece costituita da:

- gas caldi a bassa densità (CO₂, vapore acqueo, N₂, CO…);

- minuscole particelle incandescenti (che generano il caratteristico giallo, ma in quantità minime);

- forti gradienti di temperatura, che modificano l’indice di rifrazione.

Ora, questi gas non assorbono la luce visibile in modo apprezzabile.

E il fatto che siano caldi significa che la loro densità è ancora più bassa rispetto all’aria circostante.

La maggior parte dei fotoni, quindi, li attraversa senza essere bloccata, esattamente come la luce attraversa l’aria: e l’aria non fa ombra.

Ecco perché una fiamma non proietta un’ombra netta.

L’unico effetto reale: la distorsione

Se illuminate una candela con una luce molto intensa e osservate con uno sfondo uniforme, noterete non un’ombra, ma una distorsione dei contorni.

La fiamma, infatti, ha un indice di rifrazione diverso da quello dell’aria circostante, perché è più calda.

La luce viene quindi deviata leggermente.

È lo stesso effetto che si osserva sopra l’asfalto bollente d’estate: non un’ombra, ma un miraggio.

È dunque la rifrazione a rendere visibile la fiamma in certe condizioni, non l’assorbimento.

Ma allora i plasmi fanno ombra? Certo che sì.

L’altra affermazione problematicissima del video è che un plasma “lascia passare la luce senza bloccarla”.

Falso anche questo.

Dipende dal plasma.

Un plasma può assorbire luce, può diffonderla, può rifletterla.

La ionosfera terrestre, composta da plasma tenuissimo, è in grado di riflettere le onde radio: un comportamento ben più deciso del semplice “lasciare passare la luce”.

Quindi non esiste nessuna regola del tipo:

“Un plasma non fa ombra”

Semplificazione fuorviante.

Riassumendo tutto in una frase

La fiamma di una candela non fa ombra non perché è un plasma, ma perché è una miscela di gas caldi a bassa densità che non assorbe luce visibile: i fotoni la attraversano quasi indisturbati.

Molto più semplice, molto più elegante, molto più corretto.

Conclusione

La divulgazione scientifica è un’arte difficile. Bisogna trovare un equilibrio tra precisione e accessibilità.

Questa volta – mi dispiace dirlo – il pendolo della semplicità è stato spinto un po’ troppo in là.

Eppure, la vera spiegazione non solo è più corretta, ma è anche più affascinante: ci ricorda che la luce e la materia interagiscono in modi sottili, e che basta un po’ di fisica ben raccontata per scoprire meraviglie dove di solito non guardiamo.

La fiamma non fa ombra… e non ha certo bisogno di essere un plasma per farlo.

Il silenzio di Watson e la memoria imperfetta della scienza

Il palco di Stoccolma

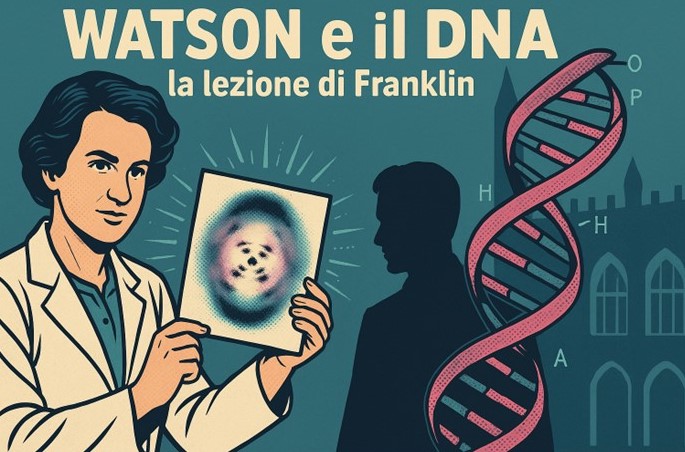

L’11 dicembre 1962, James D. Watson tenne al Karolinska Institutet la sua Nobel Lecture, The involvement of RNA in the synthesis of proteins. Accanto a lui, Francis Crick e Maurice Wilkins: i tre scienziati che pochi mesi prima avevano condiviso il Premio Nobel per la Medicina per la scoperta della struttura a doppia elica del DNA..

Watson aveva trentatré anni, la brillantezza impetuosa di chi si sente al centro del mondo e la convinzione, non infondata, di aver partecipato a uno dei momenti più rivoluzionari della biologia moderna. Parlò per poco più di mezz’ora, illustrando i meccanismi di trascrizione dell’informazione genetica e il ruolo dell’RNA nella sintesi proteica. Parlò di geni, di codici, di ribosomi.

Nel suo intervento non menzionò Rosalind Franklin.

In quella sala gremita, la scienziata che aveva fornito le immagini chiave per decifrare la struttura del DNA era già scomparsa da quattro anni. Morta di cancro a 37 anni, nel 1958, non avrebbe potuto comunque ricevere il Nobel, poiché il premio non viene assegnato postumo. Ma l’assenza del suo nome — in una lezione che celebrava la vittoria della conoscenza — resta una delle omissioni più eloquenti della storia della scienza del Novecento.

La donna che guardò dentro la doppia elica

Rosalind Franklin non era un’eroina romantica né una vittima inconsapevole. Era, piuttosto, una ricercatrice di precisione chirurgica, formata tra Cambridge e Parigi, esperta di cristallografia a raggi X. Quando nel 1951 entrò al King’s College di Londra, portava con sé un bagaglio tecnico che pochi colleghi possedevano: la capacità di ottenere e interpretare immagini di strutture cristalline con un livello di dettaglio straordinario.

Fu lei a produrre la famosa “foto 51”, un’immagine di diffrazione del DNA che mostrava con chiarezza la sua struttura elicoidale. Lavorava con rigore quasi ascetico, in un ambiente accademico tutt’altro che accogliente per le donne. A quel tempo, al King’s College l’accesso agli spazi accademici era ancora fortemente segregato per genere, a riprova del clima culturale dell’epoca.

Mentre Franklin perfezionava le sue analisi, Watson e Crick — allora a Cambridge — cercavano di costruire un modello teorico della molecola. Non avevano accesso diretto ai dati sperimentali di Franklin, ma tramite Maurice Wilkins, suo collega (e, in un certo senso, suo antagonista), Watson poté vedere la famosa foto. In quella trama di macchie nere e grigie, egli riconobbe il segno inconfondibile di una doppia elica.

Da lì, la corsa si fece rapidissima. Nel numero del 25 aprile 1953 di Nature furono pubblicati tre articoli consecutivi. Il primo, firmato da Watson e Crick, presentava il modello; il secondo, da Wilkins, Stokes e Wilson lo confermava; il terzo, da Franklin e Gosling, mostrava i dati sperimentali su cui tutto poggiava. La sequenza delle pubblicazioni lasciava intendere una collaborazione armoniosa. In realtà, la comunicazione era stata minima e la tensione, altissima.

L’oblio nella Nobel Lecture

Dieci anni dopo, durante la sua Nobel Lecture, Watson non fece alcun riferimento a quella fase cruciale. Né Franklin, né la sua foto, né il suo contributo alla comprensione della struttura del DNA comparvero nel discorso.

Non fu una semplice dimenticanza. In parte, la lecture era centrata su altri temi — l’RNA e la sintesi proteica — ma la rimozione di Franklin rifletteva qualcosa di più profondo: il modo in cui la scienza istituzionale del tempo selezionava ciò che meritava memoria.

Negli anni ’50 e ’60, il merito scientifico era ancora filtrato attraverso un paradigma fortemente gerarchico e maschile. Le donne nella ricerca erano spesso viste come assistenti, non come protagoniste; la loro presenza, quando c’era, era percepita come eccezionale o marginale. In quel contesto, il nome di Franklin non fu cancellato per complotto, ma per inerzia culturale: perché era più semplice, più lineare, raccontare la scoperta come il frutto dell’intuizione di due giovani geni di Cambridge.

La riscrittura di una storia

Nel 1968, sei anni dopo la Nobel Lecture, James Watson pubblicò The Double Helix. Il libro, presentato come un “racconto personale della scoperta del DNA”, fu un successo editoriale immediato — ma anche una tempesta.

Watson vi raccontava la vicenda come una corsa intellettuale punteggiata da intuizioni, errori e colpi di fortuna. Il tono era brillante, ironico, spesso spregiudicato. Ma il ritratto di Rosalind Franklin appariva distorto: la chiamava “Rosy”, un nomignolo che lei non usava; la descriveva come “poco femminile”, “irascibile”, “ostinata”.

Solo nelle ultime pagine, quasi di sfuggita, Watson riconosceva che i suoi dati erano stati “cruciali” per la costruzione del modello della doppia elica.

Il libro provocò una reazione immediata. Anne Sayre, amica e collega di Franklin, pubblicò nel 1975 Rosalind Franklin and DNA, un testo scritto per “restituire equilibrio” a una storia che era stata piegata al punto di vista maschile e competitivo di Watson. In seguito, biografi come Horace Freeland Judson e Brenda Maddox avrebbero contribuito a una rilettura più accurata e documentata del ruolo di Franklin.

Da allora, la sua figura è uscita dall’ombra per entrare nel pantheon — non come martire della scienza, ma come simbolo della precisione, della pazienza e dell’intelligenza metodica che completano l’intuizione geniale.

Watson dopo Watson

Col passare degli anni, Watson rilesse più volte il proprio operato. In interviste successive, Watson ha più volte riconosciuto l’importanza decisiva dei dati di Franklin.

In altre occasioni definì The Double Helix un resoconto personale, non pensato come ricostruzione storica. In pratica, un racconto soggettivo di un giovane scienziato più attento alla competizione che alla sensibilità.

Tuttavia, la sua figura pubblica continuò a essere controversa. Le sue dichiarazioni successive su razza, intelligenza e genetica provocarono dure critiche, fino alla revoca di onorificenze e incarichi. È ironico — e forse istruttivo — che l’uomo che aiutò a svelare la struttura molecolare della vita sia diventato, nella memoria collettiva, un esempio di quanto la conoscenza possa coesistere con il pregiudizio.

Il contesto: scienza, società e invisibilità

Per comprendere davvero il “silenzio” di Watson, bisogna tornare al mondo della scienza degli anni ’50.

Il dopoguerra aveva accelerato la trasformazione dei laboratori in istituzioni competitive, legate ai finanziamenti pubblici e all’industria. Il linguaggio scientifico si era fatto più aggressivo, quasi darwiniano: vincere significava pubblicare per primi, ottenere riconoscimento, attrarre risorse.

In questo clima, le dinamiche di genere erano una componente implicita ma potente. Le donne rappresentavano una minoranza esigua nei dipartimenti scientifici; raramente avevano posizioni indipendenti, e spesso il loro lavoro veniva attribuito ai supervisori maschi.

Rosalind Franklin non fu un’eccezione: fu una scienziata che osò comportarsi da pari in un mondo che la voleva subordinata. La sua intransigenza, spesso percepita come freddezza, era una forma di autodifesa in un ambiente che tollerava la competenza femminile solo se accompagnata da deferenza.

Eppure, quella stessa intransigenza è ciò che le permise di ottenere risultati di una precisione senza precedenti. In un certo senso, la sua vicenda mostra il paradosso della scienza moderna: un sistema che premia la razionalità ma è plasmato da pregiudizi irrazionali.

Il tempo della memoria

Oggi, la storia di Rosalind Franklin è raccontata nei musei, nei documentari, nelle aule universitarie. È diventata una figura di riferimento per le donne nella scienza, ma anche un simbolo più ampio: quello della necessità di una memoria scientifica capace di riconoscere i contributi oltre i miti.

La sua immagine — austera, concentrata, quasi imperscrutabile — contrasta con il tono leggero e competitivo con cui Watson e Crick raccontarono la loro impresa. Ma proprio in quella differenza risiede la lezione più profonda: la scienza non è solo un gioco di intuizioni geniali, è anche una costruzione lenta, fatta di rigore, di dubbi, di dedizione quotidiana.

Se oggi conosciamo la struttura del DNA, lo dobbiamo a entrambe le forze: all’immaginazione teorica e alla precisione sperimentale. La storia della doppia elica non è il trionfo di due uomini o la rivincita di una donna: è un intreccio di caratteri, talenti e tempi, come le due spirali del DNA stesso.

Scienza e imperfezione umana

C’è però un altro piano, più sottile, che questa vicenda invita a considerare: il rapporto tra grandezza scientifica e imperfezione umana.

Watson, con le sue omissioni e i suoi pregiudizi, non smette per questo di essere uno dei protagonisti della biologia del Novecento. E la stessa cosa vale, su altri piani, per figure come Fritz Haber, Albert Einstein o Erwin Schrödinger: uomini di ingegno straordinario ma di condotta spesso discutibile.

Haber sviluppò la reazione che porta il suo nome, permettendo la produzione di ammoniaca e, di conseguenza, la rivoluzione dei fertilizzanti sintetici. Ma fu anche l’uomo che coordinò l’uso dei gas tossici nella Prima guerra mondiale.

Einstein lasciò la prima moglie in condizioni economiche precarie e mostrò poca sensibilità nelle relazioni familiari, ma la sua teoria della relatività cambiò per sempre il nostro modo di concepire lo spazio e il tempo.

Schrödinger, genio della meccanica quantistica, visse relazioni extraconiugali palesi che scandalizzarono i suoi contemporanei.

Tutti e tre — come Watson stesso — incarnano una verità scomoda ma necessaria: la scienza non redime l’uomo, e l’uomo non deve redimere la scienza. Il valore di una scoperta non dipende dalla moralità del suo autore, così come la condotta personale non può cancellare un risultato scientifico.

Ciò che invece possiamo — e dobbiamo — chiedere è una memoria onesta, che riconosca la complessità senza mitizzare né demonizzare.

Parallelismi contemporanei

Nel mondo della ricerca di oggi, le dinamiche di potere e visibilità non sono scomparse: si sono trasformate.

Le barriere di genere si sono ridotte ma non dissolte; la competizione per la pubblicazione e il finanziamento è ancora feroce; l’autorialità collettiva rende più difficile distinguere i contributi individuali.

Le “Rosalind Franklin” contemporanee sono spesso giovani ricercatrici o ricercatori precari, che lavorano dietro le quinte di grandi progetti, i cui nomi scompaiono nelle appendici delle supplementary materials.

Eppure, qualcosa è cambiato: oggi la comunità scientifica è più consapevole del valore della diversità e della necessità di riconoscere i meriti in modo più equo. La storia di Franklin è diventata un monito e un modello, ricordando che la scienza è tanto più solida quanto più ampie sono le voci che la costruiscono.

Conclusione – La doppia elica della memoria

Il silenzio di Watson, nella Nobel Lecture del 1962, non è solo un fatto storico: è una metafora della memoria selettiva con cui la scienza, come ogni impresa umana, racconta se stessa.

Ma la memoria, come il DNA, può essere riscritta. Negli anni, le spirali dell’oblio e del riconoscimento si sono avvolte e sciolte più volte, fino a ricomporre un quadro più giusto.

Oggi ricordiamo Rosalind Franklin non per la sua marginalizzazione, ma per il suo rigore, la sua lucidità, la sua capacità di vedere ciò che altri non seppero guardare.

E forse è questa la vera eredità della sua storia: riconoscere che la scienza vive della tensione fra verità e umanità, fra il desiderio di conoscere e le debolezze di chi conosce.

Watson, Crick, Franklin, Wilkins: quattro nomi intrecciati come le due catene della doppia elica. Nessuno di loro perfetto, ma tutti parte di una stessa sequenza di scoperte, errori, intuizioni e silenzi.

La scienza — come la vita — non è mai lineare. È una spirale che, pur nascendo dall’imperfezione, continua a replicarsi nel tempo.

Riferimenti e fonti principali

- Cobb, M. (2015). Sexism in science: did Watson and Crick really steal Rosalind Franklin’s data? The Guardian

- Cobb, M., Comfort, N. (2023). What Rosalind Franklin truly contributed to the discovery of DNA’s structure. Nature, 616: 657-660

- Franklin, R.E., Gosling, R.G. (1953). Molecular Configuration in Sodium Thymonucleate. Nature, 171: 740–741.

- Judson, H.F. (1979). The Eighth Day of Creation: Makers of the Revolution in Biology. Simon & Schuster.

- Maddox, B. (2002). Rosalind Franklin: The Dark Lady of DNA. HarperCollins.

- Sayre, A. (1975). Rosalind Franklin and DNA. W.W. Norton.

- Watson, J.D. (1962). The involvement of RNA in the synthesis of proteins. Nobel Lecture. NobelPrize.org

- Watson, J.D. (1968). The Double Helix: A Personal Account of the Discovery of the Structure of DNA. Atheneum.

- Watson, J.D. (with Andrew Berry) (2003). DNA. The secret of life. Alfred A. Knopf, NY

- Wilkins, M.H.F., Stokes, A.R., Wilson, H.R. (1953). Molecular Structure of Deoxypentose Nucleic Acids. Nature, 171: 738–740.