Viaggio nei ricordi, tra scaffali ed etichette moderne

Quante volte andiamo al supermercato nel quotidiano?

Tra i venticinque e i trent’anni fa – e anche oltre – quando vivevo ad Avella, un piccolo paese in provincia di Avellino dove sono cresciuto, andare al supermercato era quasi una festa. Non ce n’erano molti in giro. Il più grande era a Nola, a circa venti minuti di auto da Avella, e lì si faceva la cosiddetta “spesa grande” una volta alla settimana. Per le urgenze quotidiane si ricorreva al negozietto sotto casa: non era fornitissimo, ma garantiva la sopravvivenza.

Poi, per motivi di lavoro, mi sono trasferito a Palermo. Oggi, nel raggio di pochi isolati da casa, ho almeno sette supermercati: tre Conad, un Todis, una COOP, un Sisa e un Prezzemolo & Vitale. Per quanto ne so, Todis e P&V sono catene siciliane: il primo è un discount, il secondo un supermercato da gourmet, frequentato da chi può permettersi di spendere.

Insomma, qui si trova di tutto, a prezzi estremamente variabili e per tutte le tasche. Ma una cosa li accomuna tutti: il marketing del “senza”. Scaffali pieni di prodotti “senza zucchero”, “senza zuccheri aggiunti”, “senza glutine”, “senza lattosio”, “senza olio di palma” e chi più ne ha più ne metta. Qualche volta mi è persino capitato di leggere “senza chimica”… che se ci pensate è davvero paradossale.

Comincia così un reportage sul marketing del “senza”. Nei limiti del tempo che ho – perché in questi giorni ricomincio le lezioni – proveremo a capire insieme cosa significhi davvero un alimento “senza”: è un vantaggio? uno svantaggio? o soltanto una questione di marketing e soldi?

In questa prima puntata analizzeremo il caso dell’olio di palma, cercando di capire quanto sia fondato il claim “senza olio di palma”, intrecciando le promesse delle etichette con i dati scientifici.

Come è nato il “senza olio di palma”

Le immagini che hanno fatto il giro del mondo

Tutto cominciò una decina di anni fa – anno più, anno meno – quando sui media iniziarono a circolare immagini drammatiche: foreste abbattute in Indonesia e Malesia, oranghi privati del loro habitat naturale, ettari di biodiversità sacrificati in nome delle grandi piantagioni di palma da olio.

Dalla foresta all’etichetta

Non era tanto la composizione chimica di questo grasso vegetale a spaventare, quanto il suo contesto produttivo. L’olio di palma divenne così il simbolo di un’agricoltura intensiva e predatoria, accusata di deforestazione, perdita di specie e sfruttamento del suolo. La pressione esercitata da ONG, associazioni ambientaliste e una crescente sensibilità dei consumatori verso la salute creò un terreno fertile: da quel momento, l’olio di palma iniziò a essere guardato con sospetto.

L’analfabetismo funzionale: un alleato insospettabile

A mio avviso su questa diffidenza ha influito anche un fenomeno ben noto in Italia: l’analfabetismo funzionale. Secondo l’indagine internazionale OCSE-PIAAC, oltre un terzo degli adulti italiani non possiede competenze sufficienti di lettura, comprensione numerica o problem solving per orientarsi in testi complessi o interpretare correttamente claim ambigui. In un simile contesto, slogan semplici e rassicuranti come “senza olio di palma” o addirittura “senza chimica” hanno trovato terreno fertile: funzionano perché non richiedono spiegazioni, non pongono domande, non obbligano ad affrontare complessità. Il consumatore si sente al sicuro, perché “senza” equivale a “meglio”.

Food literacy: la chiave mancante

Questa dinamica non è solo un’impressione. Studi sulla cosiddetta food literacy – la capacità di reperire, comprendere e valutare criticamente le informazioni legate all’alimentazione – hanno mostrato che tali competenze variano molto nella popolazione e non sono affatto scontate. In Italia, ricerche su gruppi vulnerabili (anziani, persone con basso livello di istruzione, famiglie in difficoltà economica) hanno evidenziato livelli di food literacy particolarmente scarsi. In pratica, ciò significa che questi consumatori sono più inclini ad accettare claim semplici come “senza olio di palma” senza porsi domande su quali alternative siano state usate o se davvero il prodotto sia più salutare.

Non solo un problema italiano

E il fenomeno non si limita al nostro Paese. Studi condotti in altri contesti europei, come nei Paesi Bassi, hanno rilevato difficoltà analoghe: molti consumatori dichiarano di avere competenze alimentari adeguate, ma quando si passa dalla percezione alle prove pratiche emergono limiti evidenti. Etichette, dati nutrizionali e claim vengono interpretati superficialmente e le diciture rassicuranti finiscono per agire come scorciatoie cognitive. Indagini più ampie a livello internazionale hanno confermato che la bassa food literacy non riguarda soltanto chi ha minori mezzi culturali o economici, ma può toccare anche fasce di popolazione ben istruite: non per mancanza di accesso all’informazione, bensì per scarsa abitudine a metterla in discussione. In questo scenario, i claim del tipo “senza X” risultano particolarmente efficaci perché facili da leggere, da ricordare e immediatamente comprensibili: trasmettono un’idea di purezza e di sicurezza che parla più alle emozioni che alla ragione.

Le aziende colgono il vento

Le aziende, dal canto loro, colsero subito il vento che stava cambiando. I grandi colossi dell’alimentare cominciarono a riformulare biscotti, merendine, creme spalmabili, sostituendo l’olio di palma con miscele di altri grassi vegetali. Una scelta tutt’altro che indolore: comportava costi di produzione più elevati, difficoltà tecnologiche, problemi di stabilità, modifiche al gusto e alla consistenza dei prodotti, oltre a una diversa durata sugli scaffali. Ma la pressione del mercato e la necessità di mantenere la fiducia del consumatore spinsero le aziende in questa direzione.

La nascita dell’etichetta magica

Fu in quel contesto che nacque l’etichetta magica: “senza olio di palma”. Una formula breve, accattivante, stampata a caratteri cubitali sulle confezioni. Non c’era bisogno di spiegazioni tecniche: bastava quella scritta perché il prodotto venisse percepito come più sano, più naturale, persino più etico. Nel giro di pochi anni, il “senza” si trasformò da scelta tecnica a vero e proprio marchio di purezza, un vantaggio competitivo su cui molte aziende costruirono intere campagne di marketing.

Dentro la goccia: la chimica dell’olio di palma

La tavolozza dei grassi

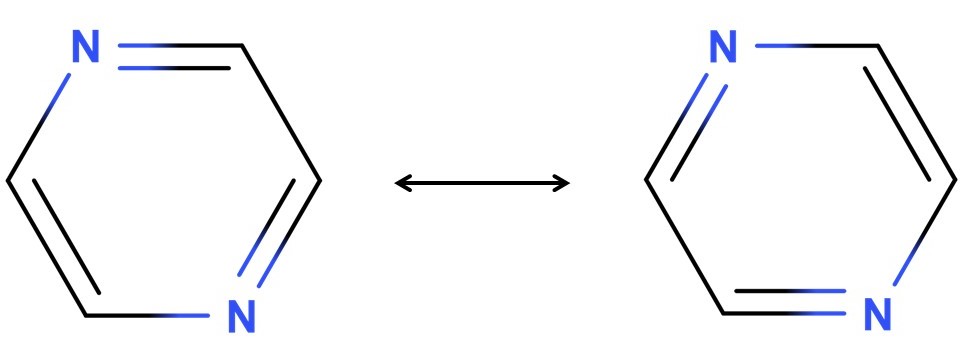

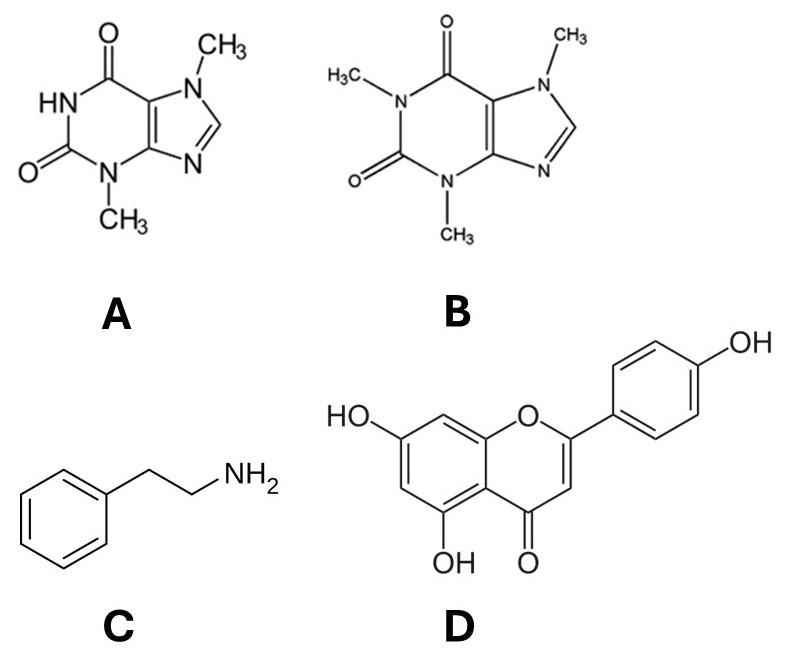

Per capire se il “senza olio di palma” è davvero un vantaggio, bisogna prima guardare dentro quella goccia arancione. L’olio di palma non è una sostanza semplice, ma una miscela di trigliceridi con un profilo ben preciso. Circa la metà è formata da acido palmitico, un grasso saturo; quasi il 40% è acido oleico, un monoinsaturo che troviamo anche nell’olio d’oliva; il resto è soprattutto acido linoleico, un polinsaturo; infine, piccole percentuali di altri acidi grassi.

Un colore che parla di carotenoidi

Questa combinazione gli conferisce proprietà particolari. A temperatura ambiente, l’olio di palma non si presenta come un liquido chiaro e fluido, ma come una massa semi-solida che può variare dal giallo al rosso vivo, soprattutto se poco raffinato. A dargli quel colore intenso sono i carotenoidi, tra cui il β-carotene – si trova, per esempio, anche nelle carote – accompagnati da vitamina E – presente anche in spinaci e broccoli – e altri antiossidanti naturali. Sono molecole che in parte si perdono con la raffinazione, ma che rendono l’olio grezzo sorprendentemente ricco.

La forza dell’industria

Dal punto di vista tecnologico, questa composizione è una manna per l’industria alimentare. L’olio di palma fonde alla temperatura giusta alla produzione di certi particolari alimenti – vi dice nulla la Nutella? – dà struttura agli impasti, allunga la conservazione e resiste abbastanza bene al calore. È per questo che biscotti, creme spalmabili e snack lo hanno adottato per anni: era pratico, economico e stabile.

Il rovescio della medaglia

C’è però l’altro lato della medaglia. L’elevata quota di grassi saturi è collegata scientificamente a un aumento del rischio cardiovascolare se consumati in eccesso. Non è una peculiarità esclusiva dell’olio di palma: lo stesso vale per burro, strutto e altri grassi solidi. Ma certo, un prodotto che contiene circa il 50% di acidi grassi saturi non può essere definito del tutto innocuo.

È la dose che fa il veleno

Infine, va ricordato un rischio meno noto: quello dei contaminanti da processo. Quando gli oli vegetali vengono trattati ad alte temperature per essere raffinati e stabilizzati, si possono formare composti indesiderati – prodotti di ossidazione e degradazione – che destano preoccupazione per la salute. È un problema che riguarda in generale tutti gli oli industrialmente trattati, non solo la palma, ma che contribuisce ad alimentare il sospetto verso questo ingrediente.

Eppure, come ammoniva Paracelso già nel Cinquecento, “è la dose che fa il veleno”. Se consumiamo alimenti con olio di palma in modo moderato, senza farne un ingrediente quotidiano e abbondante, e al tempo stesso seguiamo una dieta equilibrata ricca di frutta e verdura, il rischio legato al suo consumo diventa davvero minimo.

Dal claim alla ricetta: cosa cambia davvero

Tolto un ingrediente, ne arriva un altro

Qui entriamo nella parte più delicata della storia. Perché non basta dire “senza olio di palma”: bisogna chiedersi cosa c’è al suo posto. Quando le aziende hanno tolto la palma, hanno dovuto sostituirla con qualcos’altro: olio di girasole, di colza, di soia, di cocco, oppure burro e altri grassi animali.

Il mito del più salutare

E qui arriva la sorpresa. Non è affatto detto che la sostituzione abbia reso i prodotti automaticamente più salutari. Alcune formulazioni hanno finito per usare altri grassi saturi, mantenendo alto il contenuto complessivo di tali sistemi chimici. In certi casi, per non perdere cremosità o gusto, sono stati aggiunti più zuccheri, conservanti o aromi. Insomma, il “senza olio di palma” non sempre coincide con il “meglio per la salute”: dipende da come è stato ribilanciato l’insieme della ricetta.

La giungla dietro il campo di girasoli

Anche sul fronte ambientale le cose non sono così nette. La palma da olio viene giustamente criticata per la deforestazione e la perdita di habitat, ma è anche la pianta con la resa più alta in assoluto: da un ettaro di terreno produce molto più olio rispetto a soia, girasole o colza. Eliminare la palma può voler dire coltivare superfici maggiori, consumare più acqua o fertilizzanti, e spostare il problema altrove. In pratica, non sempre sostituire significa ridurre l’impatto: a volte lo si moltiplica, solo che succede lontano dai riflettori.

Un’etichetta rassicurante, una realtà complessa

In definitiva, il “senza olio di palma” va preso per quello che è: un claim semplice e rassicurante, che però nasconde una realtà più complessa. Dietro la scritta in grassetto sull’etichetta, quello che conta davvero è l’equilibrio della dieta e l’attenzione al sistema produttivo complessivo.

Le magie del marketing

La forza di una parola breve

Il bello del marketing è che sa parlare alle emozioni prima ancora che alla ragione. Nel momento in cui sui pacchi di biscotti è comparsa la scritta “senza olio di palma”, molti consumatori hanno percepito quel prodotto come più sano, più pulito, persino più etico. Non servivano dati, né spiegazioni: bastava il “senza” per evocare un miglioramento generale, anche quando, a guardare bene l’etichetta, non era affatto scontato.

La comunicazione a senso unico

La comunicazione, del resto, funziona così: mette in luce solo la parte che conviene. Sul cartone c’è scritto cosa è stato tolto, raramente cosa è stato messo al suo posto. Il risultato è che la complessità sparisce, e il messaggio si riduce a una formula semplice, facilmente assimilabile.

Gli slogan che abbiamo già sentito

Vi ricordano qualcosa questi meccanismi? Somigliano molto agli slogan dei partiti politici: brevi, accattivanti, costruiti per acchiappare i gonzi. Piacciono a chi non ha voglia di pensare, e dall’alto di una presunta superiorità etica o cognitiva crede di poter risolvere problemi complessi con semplici parole.

Il prezzo nascosto del senza

Dietro questa apparente semplicità, però, ci sono i costi nascosti. Per i produttori: materie prime più care, nuove difficoltà tecniche, ricette da bilanciare di nuovo. Per i consumatori: possibili differenze nel gusto, nella consistenza, nella durata dei prodotti, a volte anche un prezzo più alto. Tutto questo rimane dietro le quinte, invisibile rispetto alla promessa rassicurante del “senza”.

La battaglia delle contro-narrazioni

E infine c’è il gioco delle contro-narrazioni. Non tutte le aziende hanno scelto di eliminare l’olio di palma: alcune hanno puntato sulla certificazione di filiera sostenibile (come lo standard internazionale RSPO), rivendicando un uso responsabile invece di una cancellazione totale. In questo scenario, i claim rischiano di diventare un campo di battaglia comunicativo: da un lato chi sfrutta il “senza” come bandiera di purezza, dall’altro chi difende la palma sostenibile e accusa gli avversari di greenwashing.

Conclusione: non tutto è bianco o nero

Il “senza olio di palma” si è trasformato in pochi anni da scelta tecnica a potente strumento di marketing. Ha fatto leva su paure, convinzioni salutistiche e preoccupazioni ambientali, condensando tutto in una scritta breve e rassicurante.

Eppure, se guardiamo con gli occhi della chimica, il quadro è meno netto. L’olio di palma ha i suoi lati oscuri: un alto contenuto di grassi saturi che, se consumati in eccesso, aumentano il rischio cardiovascolare. Ma non è nemmeno il peggiore dei grassi: porta con sé carotenoidi, vitamina E e una stabilità chimica che altri oli non hanno.

Toglierlo non è di per sé garanzia di miglioramento. Dipende da cosa lo sostituisce, da come viene riformulato il prodotto, da quanto “senza” significhi davvero “meglio”. A volte si guadagna, altre volte si perde: in gusto, in salute, in sostenibilità.

Per noi consumatori, la lezione è semplice ma non banale: non fermarsi allo slogan. Vale la pena leggere le etichette, controllare le tabelle nutrizionali, chiedersi da dove viene un ingrediente e come è stato prodotto. Solo così il “senza” smette di essere una parola magica e torna a essere quello che dovrebbe: un’informazione utile, da interpretare con spirito critico.

Per quanto mi riguarda, quando nei supermercati leggo “senza olio di palma” passo oltre e scelgo altri prodotti.

Riferimenti & Approfondimenti

A cura della Ferrero Olio di palma: 7 luoghi comuni da sfatare. Disponibile online

A cura dell’Unione Olio di palma sostenibile I consumi “senza”: tra false credenze e paure degli italiani. il caso dell’olio di palma. Disponibile online

A cura della Redazione di Romagna a Tavola L’inganno delle etichette “senza olio di palma”: verità e marketing. Disponibile online

Adamu Muhammad Alhaji & al. (2024) Palm Oil (Elaeis guineensis): A Journey through Sustainability, Processing, and Utilization. Foods. 13(17): 2814 https://doi.org/10.3390/foods13172814

Annamaria Mancini & al. (2015) Biological and Nutritional Properties of Palm Oil and Palmitic Acid: Effects on Health. Molecules. 20(9):17339–17361. doi:10.3390/molecules200917339

Arturo Arias & al. (2023) Palm Oil and Coconut Oil Saturated Fats: Properties, Food Applications, and Health. World Journal of Food Science and Technology. 7(1): 9-19 DOI: 10.11648/j.wjfst.20230701.12

Giancarlo Navach & Francesca Landini (2017) Insight: Che Nutella sarebbe senza olio di palma? Ferrero passa al contrattacco. Reuters. Disponibile online

Giovanni Giorgi (2019) “Senza olio di palma”: l’inganno del claim, confronto alla mano. Dissapore. Disponibile online

Hanne C. S. Sponselee & al. (2021) Food and health promotion literacy among employees with a low and medium level of education in the Netherlands. BMC Public Health. 21: 1273 https://doi.org/10.1186/s12889-021-11322-6

Hyelim Yoo & al. (2023) Who has a high level of food literacy, and who does not?: a qualitative study of college students in South Korea. Nutr Res Pract. 2023 Aug 3;17(6):1155–1169. DOI: 10.4162/nrp.2023.17.6.1155

Luca Zorloni (2016) In Italia dilaga il “senza olio di palma”, ma questo non è un bene. Wired. Disponibile online

Paula Silva & al. (2023) Nutrition and Food Literacy: Framing the Challenges to Health Communication. Nutrients. 15(22): 4708. https://doi.org/10.3390/nu15224708

Rocco Palumbo & al. (2019) Unravelling the food literacy puzzle: Evidence from Italy. Food Policy. 83: 104-115. https://doi.org/10.1016/j.foodpol.2018.12.004

Sky TG24 (2024) Analfabetismo funzionale in Italia per un terzo degli adulti: il rapporto Ocse. Disponibile online