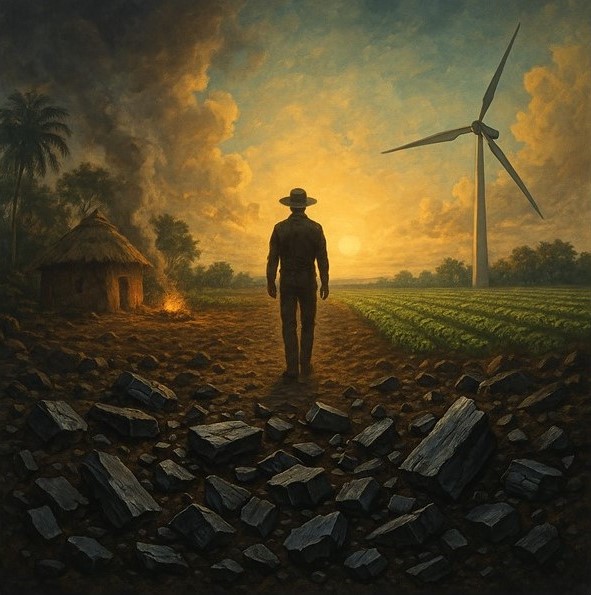

In Italia chiediamo all’Università di fare tutto: diplomare in fretta, “piacere” alle aziende, trattenere i giovani. Poi la misuriamo soprattutto su quanti contratti sforna a 6 o 12 mesi dalla laurea. È così che un’istituzione nata per allargare l’orizzonte si restringe fino a somigliare a un centro per l’impiego. A Palermo lo vedo ogni giorno: ad Agraria, la larga maggioranza degli studenti proviene dal territorio immediato; eppure, il tessuto produttivo che dovrebbe accoglierli non ha la profondità né la diversificazione necessarie per trasformare ogni laurea in un posto “pronto all’uso”.

Se allarghiamo lo sguardo, però, la Sicilia orientale corre con un passo diverso: le Università di Catania e di Messina si innestano su filiere più dinamiche – dalla vitivinicoltura etnea al lattiero-caseario ibleo – che offrono sbocchi più strutturati. È l’immagine in scala di un Paese a due velocità, con un Mezzogiorno meno sviluppato del Nord.

E quindi? Se continuiamo a misurare tutte le università con lo stesso metro corto (placement a 6–12 mesi), penalizziamo proprio chi lavora nei contesti più fragili e spingiamo tutti a piegare l’offerta verso l’addestramento. Il risultato è produrre laureati perfetti per l’oggi ma vulnerabili al domani. La via d’uscita è duplice: rimettere al centro la formazione lunga (metodo, scrittura, numeracy, pensiero critico) e costruire ponteggi seri verso il lavoro (tirocini post-laurea, co-progettati e retribuiti), senza trasformare i corsi in manuali d’officina.

Un dato che inquieta (e uno che orienta)

Il dato che inquieta non è l’assenza di lavoro in assoluto: è la fragilità dell’ecosistema che dovrebbe assorbire profili ad alta qualificazione. Quando il bacino economico è poco articolato, la richiesta di competenze specialistiche si spegne a intermittenza. Ne consegue un messaggio distorto: “Formate persone già pronte a fare X, Y, Z”. Ma se domani X evapora e dopodomani serve W, cosa resta? Resta l’unica bussola che non scade: metodo, pensiero critico, scrittura e numeracy, insieme alla capacità di apprendere in fretta ciò che cambia. È questo che dovrebbe orientare l’Università, non l’ultimo capitolato tecnico.

Quando l’ateneo imita l’azienda (e perché è una cattiva idea)

Negli ultimi anni ha preso piede una tentazione: modellare i corsi come “linee di montaggio” di competenze operative, con sillabi che sembrano manuali d’officina e con indicatori che misurano la resa a brevissimo termine. Le parole chiave sono note: “stakeholder”, “allineamento”, “filiera”. Nulla di male, finché restiamo nella sfera del dialogo; il problema nasce quando il dialogo si trasforma in subalternità. L’università che imita l’azienda smette di essere un luogo di produzione di conoscenza per ridursi a centro di addestramento. La differenza è sottile e decisiva: l’addestramento è reattivo (ti insegno a fare ciò che oggi serve), la formazione è proattiva (ti preparo a imparare ciò che servirà). Scegliere la prima strada può dare rendimenti immediati; scegliere la seconda crea cittadini e professionisti capaci di attraversare molteplici contesti.

Occupabilità ≠ addestramento

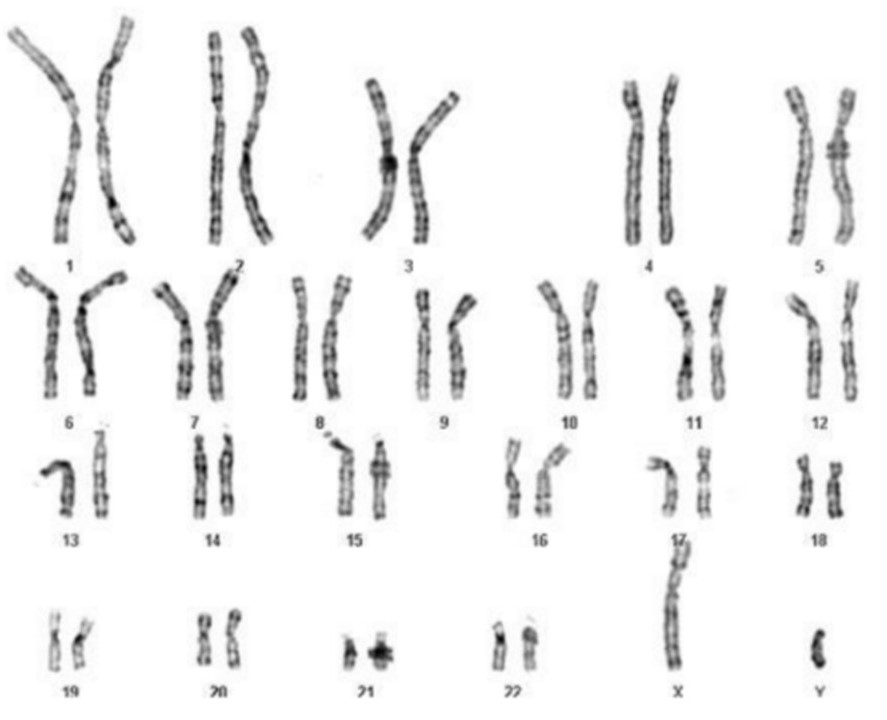

Qui sta l’equivoco da sciogliere: occupabilità non è sinonimo di addestramento. L’occupabilità è un insieme di competenze trasferibili: padroneggiare un linguaggio formale (matematica, statistica), saper leggere e scrivere testi complessi, saper argomentare, saper lavorare con dati imperfetti, saper collaborare e dare/ricevere feedback, sapere che cos’è un errore e come si corregge. A queste si aggiunge la competenza forse più preziosa: imparare a imparare.

L’addestramento, invece, è l’acquisizione di procedure specifiche: quel software con quella versione, quel protocollo con quei parametri, quella macchina con quel pannello di comando. È utilissimo, ma per definizione mutevole e context-dependent. Non può diventare la spina dorsale dei corsi di laurea senza svuotare l’Università della sua missione.

Cosa compete all’Università (e cosa no)

All’Università compete la costruzione dell’equipaggiamento mentale: metodo scientifico, profondità culturale, etica della responsabilità, consapevolezza del limite, pratica dell’incertezza. Compete anche il contatto con i problemi reali: laboratori, tesi su casi veri, seminari con pratiche professionali, service learning. Quello che non compete è trasformare il percorso di studi in un’accozzaglia di micro-addestramenti che invecchiano mentre li insegni. Le procedure – sacrosante – spettano principalmente ai contesti di lavoro, a tirocini post-laurea seri e retribuiti, alla formazione in ingresso che ogni impresa dovrebbe garantire se intende davvero investire sulle persone.

Il caso Palermo: il nodo non è solo la “domanda”

Palermo è un laboratorio interessante: straordinario patrimonio culturale, capitale umano pieno di talento, università che fa ricerca e didattica di qualità e allo stesso tempo un’economia che fatica a chiedere sistematicamente profili avanzati. Di fronte a questa asimmetria, inseguire l’idea dell’“università-azienda” è una scorciatoia che non funziona. Primo, perché l’offerta formativa si appiattisce sulle mansioni presenti – limitate – e smette di preparare al di là dell’angolo; secondo, perché si alimenta una sudditanza culturale ed economica: l’ateneo come esecutore di compiti, non come attore che innova e sperimenta.

La risposta non è voltare le spalle alle imprese, né rifugiarsi in una torre d’avorio. La risposta è alzare l’asticella della formazione generale e insieme costruire ponteggi concreti: progetti comuni, incubatori di idee, spin-off quando ha senso, tirocini seri e ben disegnati. Ma senza capovolgere i ruoli: l’Università non è un’officina esterna; è un bene pubblico che genera esternalità positive di lungo periodo (conoscenza, cittadinanza, democrazia cognitiva), spesso invisibili agli indicatori trimestrali.

Obiezioni (e risposte oneste)

“Però i nostri ragazzi vogliono lavorare subito.”

Certo. E nessuna università responsabile disprezza i tempi di inserimento. Ma se confondiamo tempi rapidi con addestramenti rapidi, li stiamo danneggiando: li rendiamo perfetti per il presente e vulnerabili al futuro.

“Le aziende chiedono competenze specifiche; non possiamo ignorarle.”

Non vanno ignorate: vanno incorniciate. L’Università offre i fondamentali e il metodo; le imprese completano, attraverso percorsi mirati e aggiornabili. Il contrario produce laureati “obsoleti in anticipo”.

“Così però rischiate di formare disoccupati colti.”

No, se il percorso è rigoroso (matematica, statistica, informatica di base, scrittura, lingua, laboratorio serio), esigente (prove autentiche, tesi che non siano riassunti), e aperto (contatti con il mondo). Quello che produce disoccupazione non è la cultura, è la povertà di ecosistema.

“Senza placement alto i finanziamenti calano.”

Questo è un problema di indicatori: se misuri solo una dimensione, modelli i comportamenti per compiacere la metrica. Servono indicatori plurali che pesino didattica, qualità della ricerca, impatto culturale e sociale, non soltanto quanti contratti compaiono a breve.

Cinque mosse possibili (concrete e realistiche)

- Doppio binario trasparente.

Dichiarare senza complessi quali percorsi sono principalmente professionalizzanti (con skill operative ben marcate) e quali sono accademico-culturali (metodo, ricerca, ampiezza). Pari dignità, criteri di valutazione diversi. Così si riduce l’ambiguità e si responsabilizzano tutti. - Tirocini post-laurea co-progettati (e retribuiti).

Evitiamo di diluire i corsi di laurea in mille micro-stage. Piuttosto, costruiamo ponti seri dopo la laurea, con tutoraggio congiunto, obiettivi chiari e oneri a carico dell’impresa che beneficia del lavoro del neolaureato. Questo riduce lo scollamento tra “teoria” e “pratica” senza snaturare i piani di studio. - Indicatori di qualità più equilibrati.

Affianchiamo al placement breve altri segnali: qualità della didattica (con misure che guardino davvero all’apprendimento, non alla simpatia del docente), produzione scientifica di base, iniziative di public engagement, collaborazione con scuole e territorio. Un sistema di valutazione più ricco incentiva scelte più sagge. - Perequazione per gli atenei in aree deboli.

Chi lavora dove l’ecosistema economico è fragile non può giocare con le stesse carte di chi opera in distretti iper-dinamici. Serve un fondo perequativo strutturale, legato a progetti di impatto (culturale, educativo, civile), non solo a brevetti e contratti conto terzi. È una misura di giustizia territoriale, non un sussidio. - Mobilità studentesca interna con borse ad hoc.

Favoriamo la circolazione Sud↔Nord (e viceversa) con borse mirate e alloggi a canone calmierato. Non per trasformare la mobilità in esodo, ma per farne una andata e ritorno: si esce per imparare e si rientra con competenze che arricchiscono il territorio. L’Università può essere la regia di questa mobilità intelligente.

Cosa significa “formare” (sul serio)

Formare non è soltanto trasmettere contenuti; è costruire abitudini di mente. Insegnare a distinguere un fatto da un’opinione, una fonte solida da una rumorosa, un ragionamento valido da una scorciatoia. È mettere i ragazzi nelle condizioni di sbagliare in sicurezza, rifare, migliorare. È allenarli alla curiosità disciplinata: quella che pone domande buone e non si accontenta di risposte facili. È anche educare alla responsabilità: il “come” si lavora conta quanto il “cosa” si fa. Chi ha attraversato un laboratorio serio sa che un dato “bello” ma ottenuto male è un dato falso e che la meticolosità non è mania: è etica.

Queste non sono chiacchiere astratte: si traducono in corsi che chiedono letture e scritture non superficiali, che presentano problemi aperti (senza esito unico), che valutano con prove autentiche (progetti, analisi di casi, laboratori) e non solo con quiz di riconoscimento. Quando uno studente vive questa palestra, l’addestramento diventa una passeggiata: gli basteranno poche settimane in azienda per imparare la procedura specifica, perché ha interiorizzato la procedura generale: osservare, ipotizzare, testare, correggere.

Che cosa perdiamo quando pieghiamo la testa

Quando trasformiamo l’Università in training center, perdiamo tre cose insieme:

- Resilienza individuale: prepariamo persone adatte a oggi e inadeguate a domani.

- Ricchezza collettiva: la ricerca di base e la cultura diffusa sono i fertilizzanti invisibili dell’innovazione; tagliarle significa sterilizzare il terreno.

- Libertà: chi non ha strumenti per pensare dipende dal manuale e da chi lo scrive.

Sono perdite difficili da misurare a breve, ma pesantissime a lungo. Un Paese che smette di investire nel pensiero lungo finisce per rincorrere ogni marea.

La mia Università

La mia Università non è un’azienda e non è un tempio. È una fucina di idee in cui si sbaglia e si impara, si discute e si costruisce, si fa ricerca seriamente e si insegna con passione. È un luogo aperto: alle scuole, alle imprese, ai cittadini. Ma rifiuta di farsi governare dal presentismo. Se qualche “stakeholder” storce il naso, dialoghiamo; se chiede subalternità, rispondiamo di no: non per superbia, ma per fedeltà alla missione.

A Palermo questa fedeltà conta doppio. Perché qui la tentazione dell’adattamento al ribasso è forte. E invece la nostra responsabilità è alzare lo sguardo: formare persone capaci di stare nel mondo – a Palermo, a Catania, a Milano, a Berlino – senza smarrire le proprie radici e senza rinunciare all’ambizione.

Conclusione: allenare la libertà

L’Università che difendo non fabbrica mansioni: allena alla libertà. Chi esce da un buon percorso universitario sa imparare veloce, sa comunicare con chiarezza, sa riconoscere un buon argomento, sa dubitare con metodo. È occupabile perché è pensante, non perché è già addestrato all’ultimo aggiornamento software o hardware. L’addestramento si impara lavorando; l’orizzonte – quello sì – si impara studiando.

Se ricominciamo da qui, non solo ridaremo dignità all’istituzione; daremo anche più chances ai nostri giovani, a Palermo come altrove. Perché la migliore garanzia di lavoro, nel lungo periodo, resta la capacità di cambiare lavoro senza perdere se stessi. E questa, nessun corso di addestramento potrà mai prometterla.